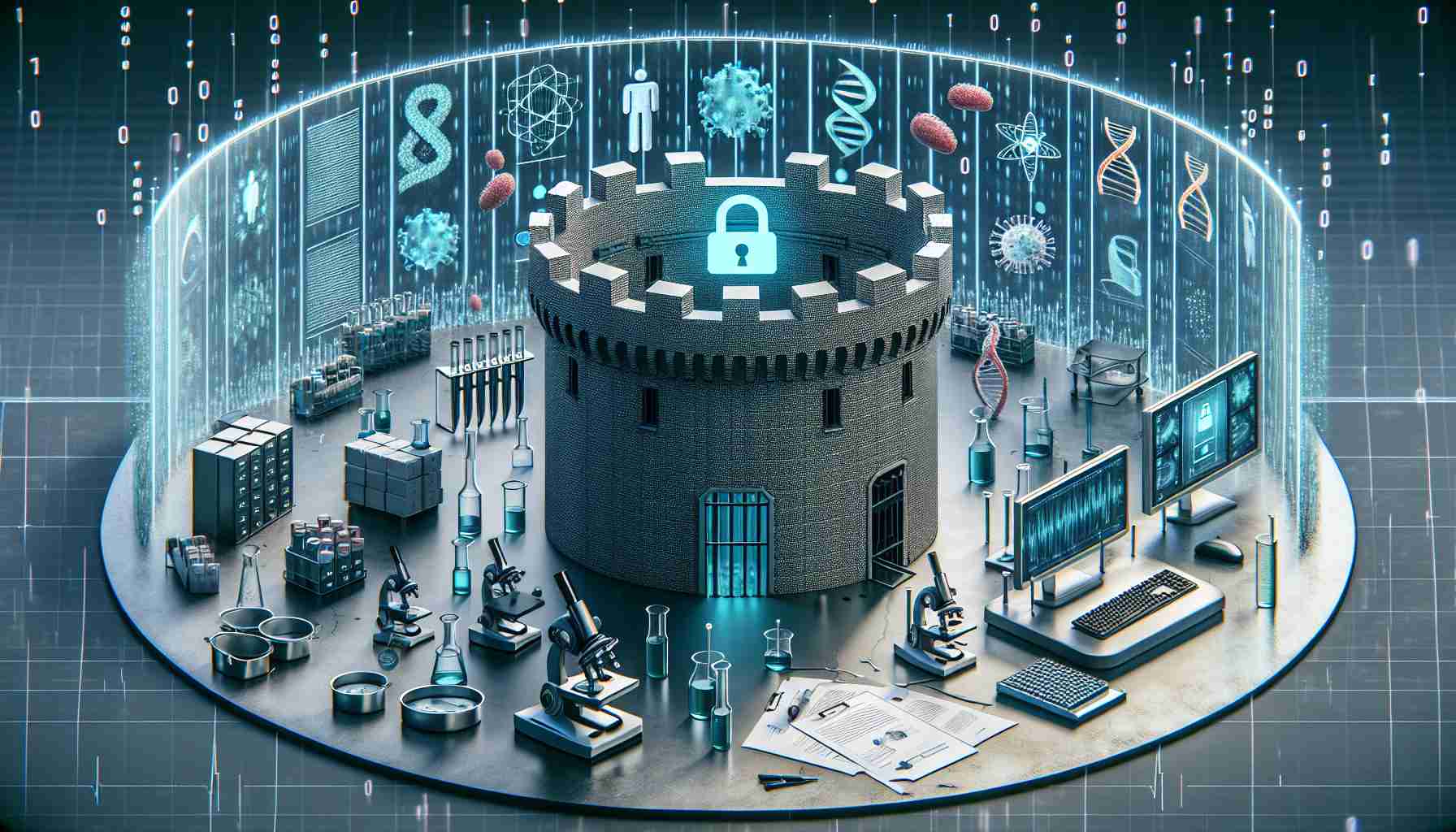

Et forskningsteam fra KAUST har gjort betydelige fremskridt med at tackle udfordringen med at integrere kunstig intelligens (AI) med genomiske data samtidig med at sikre privatlivet for enkeltpersoner. Ved at udnytte et ensemble af privatlivsbeskyttende algoritmer har teamet udviklet en maskinlæringsmetode, der optimerer modelpræstationen uden at gå på kompromis med privatlivet.

Den traditionelle metode med at kryptere data for at beskytte privatlivet medfører beregningsmæssige udfordringer, da data skal dekrypteres til træning. Denne tilgang undlader også at eliminere opbevaring af private oplysninger i den trænede model. Omvendt indebærer opdeling af data i mindre pakker til træning ved hjælp af lokal træning eller fødereret læring risikoen for lækage af private oplysninger.

For at overvinde disse begrænsninger indarbejdede forskningsteamet en decentraliseringsshuffler-algoritme i deres privatlivsbeskyttende maskinlæringsmetode. Ved at tilføje en shuffler inden for differential privatlivsfremgangsmåden opnåede de bedre modelpræstation, samtidig med at de opretholdt det samme niveau af privatlivsbeskyttelse. Denne decentraliserede tilgang fjernede tillidsproblemer forbundet med en centraliseret tredjeparts shuffler og opnåede en balance mellem privatlivsbeskyttelse og modelkapacitet.

Teamets tilgang, kendt som PPML-Omics, demonstrerede sin effektivitet ved at træne repræsentative dybdelæringsmodeller til udfordrende multi-omics-opgaver. Ikke alene overgik PPML-Omics andre metoder med hensyn til effektivitet, men den viste sig også at være modstandsdygtig over for avancerede cyberangreb.

Denne forskning understreger den stigende betydning af privatlivsbeskyttelse inden for dyblæring, især når den anvendes til analyse af biologiske og biomedicinske data. Dyblæringsmodellers evne til at bevare private oplysninger fra træningsdata udgør betydelige privatlivsrisici. Derfor er det afgørende at kombinere privatlivsbeskyttende algoritmer med maskinlæringsteknikker for at fremme medicinsk forskning samtidig med at beskytte individets privatliv.

Ved at opnå en balance mellem privatliv og modelpræstation åbner PPML-Omics-tilgangen nye muligheder for at fremskynde opdagelsen af genomiske data. Den giver forskere mulighed for at udnytte AI’s kraft til medicinsk forskning uden at gå på kompromis med individets privatliv.

FAQ:

1. Hvilken udfordring håndterede forskningsteamet fra KAUST?

– Forskningsteamet adresserede udfordringen med at integrere kunstig intelligens (AI) med genomiske data samtidig med at sikre privatlivet for enkeltpersoner.

2. Hvordan optimerede holdet modelpræstationen uden at gå på kompromis med privatlivet?

– Holdet udnyttede et ensemble af privatlivsbeskyttende algoritmer og indarbejdede en decentraliseret shuffler-algoritme i deres privatlivsbeskyttende maskinlæringsmetode.

3. Hvad er begrænsningerne ved den traditionelle metode til kryptering af data til beskyttelse af privatlivet?

– Den traditionelle metode til kryptering af data kræver dekryptering til træning, og den bevarer private oplysninger i den trænede model.

4. Hvordan introducerer opdeling af data i mindre pakker til træning risikoen for lækage af private oplysninger?

– Opdeling af data i mindre pakker til træning ved brug af lokal træning eller fødereret læring introducerer risikoen for lækage af private oplysninger.

5. Hvad er den decentraliserede shuffler-algoritme, som forskningsteamet brugte?

– Forskningsteamet indarbejdede en decentraliseret shuffler-algoritme i deres privatlivsbeskyttende maskinlæringsmetode, som opererer inden for differential privatlivsfremgangsmåden.

6. Hvad er navnet på tilgangen udviklet af teamet?

– Tilgangen udviklet af teamet kaldes PPML-Omics.

7. Hvordan præsterede PPML-Omics-tilgangen i forhold til andre metoder?

– PPML-Omics-tilgangen overgik andre metoder med hensyn til effektivitet og modstandsdygtighed over for avancerede cyberangreb.

8. Hvad er betydningen af privatlivsbeskyttelse i dyblæring anvendt på biologisk og biomedicinsk dataanalyse?

– Dyblæringsmodeller har evnen til at bevare private oplysninger fra træningsdata, hvilket udgør betydelige privatlivsrisici. Privatlivsbeskyttelse er afgørende for at fremme medicinsk forskning samtidig med at beskytte individets privatliv.

9. Hvordan balancerer PPML-Omics-tilgangen privatliv og modelpræstation?

– PPML-Omics-tilgangen opnår en balance mellem privatlivsbeskyttelse og modelkapacitet, hvilket giver forskere mulighed for at udnytte AI’s kraft til medicinsk forskning uden at gå på kompromis med individets privatliv.

Nøgleord og jargon:

– Kunstig intelligens (AI): Simulationen af menneskelig intelligensprocesser ved hjælp af maskiner, især computersystemer.

– Genomiske data: Information om en organisms komplette sæt af DNA, herunder gener og ikke-kodende DNA-sekvenser.

– Privatlivsbeskyttende algoritmer: Algoritmer designet til at beskytte privatlivet for enkeltpersoner ved at sikre datas fortrolighed og sikkerhed.

– Maskinlæring: En del af AI, der gør det muligt for systemer at lære og forbedre sig ud fra erfaring uden eksplicit programmering.

– Kryptering: Processen med at konvertere information til en ulæselig format for at forhindre uautoriseret adgang.

– Dekryptering: Processen med at konvertere krypteret information tilbage til dens originale form.

– Differential privatliv: Et rammeværk, der giver matematiske garantier for beskyttelse af privatlivet ved analyse af følsomme data.

– Dyb læring: En delmængde af maskinlæring, der bruger kunstige neurale netværk til at modellere og forstå komplekse mønstre og relationer i data.

Foreslåede relaterede links:

– KAUST: KAUST’s officielle hjemmeside, hvor institutionen, hvor forskningsteamet udførte deres studie.

– National Center for Biotechnology Information (NCBI): En ressource for biologisk og biomedicinsk information, der giver adgang til en stor samling af genomiske data.

– FN – Menneskerettigheder: Information om privatlivsrettigheder og betydningen af at beskytte individets privatliv i den digitale tidsalder.

The source of the article is from the blog aovotice.cz