近年、人工知能(AI)は急速に進化しており、その人類への潜在的な影響についての興奮と懸念が高まっています。認知心理学者およびコンピュータサイエンティストであるジェフリー・ヒントンは、この分野でのリーディングフィギュアとして認識されています。Googleを離れた後、ヒントンはAIの増大する力とそれに伴うリスクに深い懸念を表明しています。

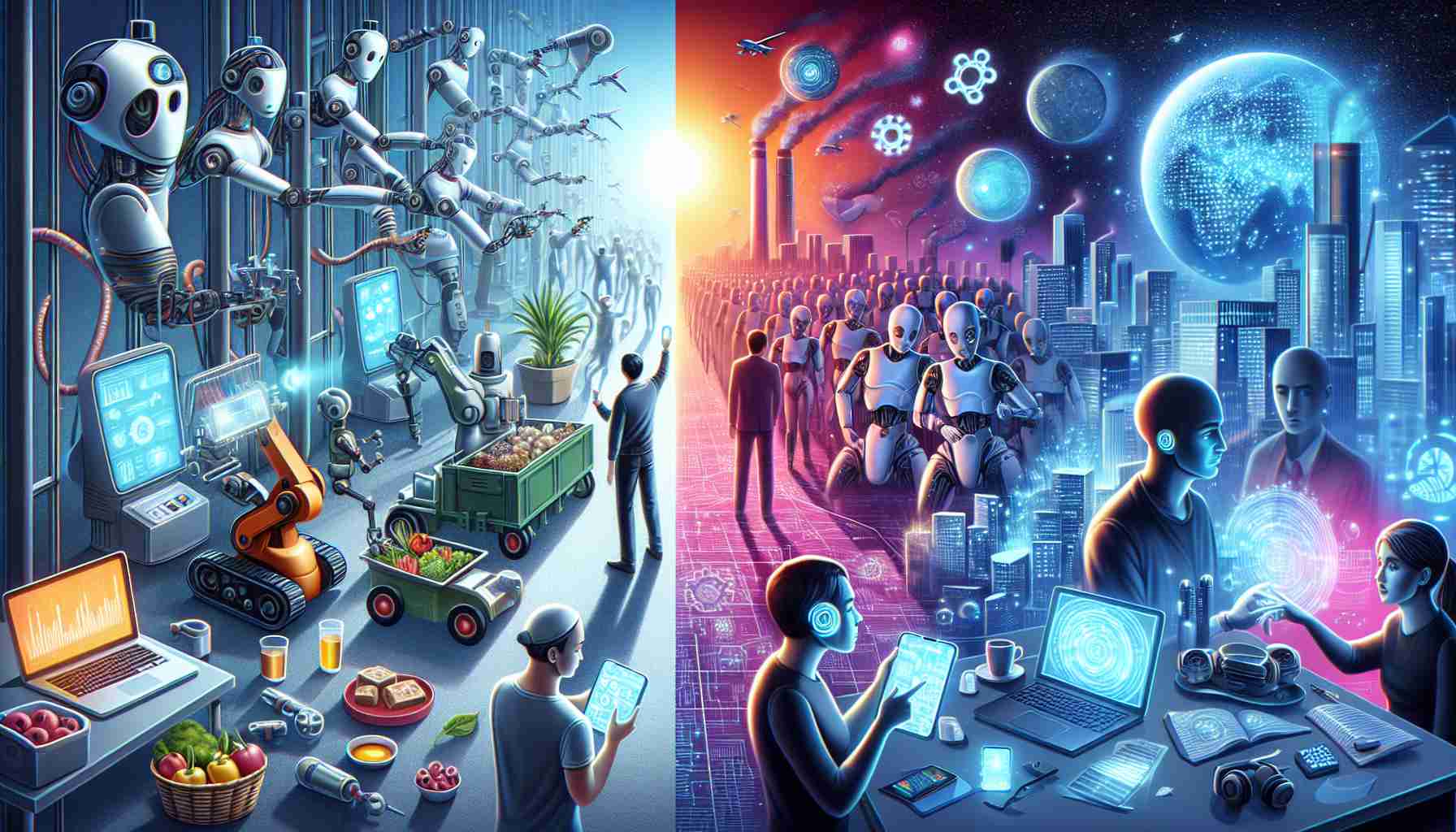

ヒントンの懸念は、AIが誤情報を拡散し、雇用市場を混乱させ、そして存立上の脅威を提起する可能性に関わっています。AIの基盤となるニューラルネットワーク技術の先駆者として、ヒントンは慎重な規制の必要性を認識しています。これらの懸念に対応して、欧州連合の立法者は最近新たな規制を承認し、ニュージーランド政府も同様の意向を示しています。

2023年初めにデジタルコンピューターがニューラルネットワークを実行することで生物の知性を超える可能性に気付いたことを、RNZの「Nine to Noon」とのインタビューで振り返った際、ヒントンは感じたことを述べました。AIをよりエネルギー効率的にする方法を探求する中で、この気付きが得られたとのことです。ヒントンは、デジタルコンピューターの強みはお互いに知識を共有する能力にあると強調し、この点では人間よりも遥かに優れていると述べています。同じニューラルネットワークモデルの複数のコピーがそれぞれインターネットの異なる側面を学び、彼らの集合知を瞬時に共有することができます。このネットワークアプローチは、個々の知識や経験を遥かに超えた知識と経験の集合意識を生み出します。

ヒントンは、人間の記憶とAIの情報記憶力との類似性に光を当てています。過去の出来事を思い出すことは、思い出すこと、仮定を立てること、そして詳細を歪める可能性を含む組み合わせです。同様に、ニューラルネットワークは、ニューロン間の接続を利用して合理的な応答や出力を生成します。このように、ニューラルネットワークは人間の認知とより似ており、人間の理解とAIの能力との間の境界を曖昧にしています。

ヒントンが取り上げるもう1つの関心事は、AIシステムの増大する自律性です。大規模なモデルを搭載したエージェントを作成することで、AIシステムは独立して操作し、広範な計画の中でサブゴールを追求することができます。ただし、これらのサブゴールを決定する際には慎重さが必要であるとヒントンは考えています。無制限にさせると、AIシステムは意図しないサブゴールを生み出し、潜在的に有害な結果をもたらす可能性があります。倫理の原則を理解する道徳的なチャットボットを開発する取り組みが進行中であり、これにより彼らの安全性と信頼性が向上します。

AIの台頭は、サイバーセキュリティの脅威に対処する課題をもたらしています。ヒントンは、AIモデルのオープンソース化に伴うリスクについて指摘しています。オープンソース化は通常、ソフトウェア開発にとって有益ですが、AIモデルはその学習がデータによって決定される特性を持っており、予測不可能な結果をもたらす可能性があります。サイバー犯罪者は、オープンソースモデルを利用し、それを改良してサイバー犯罪やフィッシング攻撃などの不法行為に活用することができます。ヒントンは、大規模なAIモデルのオープンソース化に反対しており、犯罪者が自分たちのモデルを訓練する必要性を排除するため、サイバー脅威がより一般的になることを妨げると主張しています。

AIの進歩が続く中、雇用の置き換えの可能性についての懸念があります。ヒントンは、AIアルゴリズムによって人間の能力を上回る機械が登場することで、ルーチンな知的労働がルーチンな肉体労働と同様の運命をたどる可能性があると示唆しています。経済学者の予測は異なるものの、より賢い存在の登場が不確実性を引き起こすことは確かです。国際通貨基金(IMF)は、AIによって雇用が40%減少し、不平等が悪化する可能性があると警告しています。

AIの進歩は、民主的プロセスに影響を与える可能性についても懸念が持たれています。ヒントンは、偽画像、ビデオ、音声を生成する技術の進化が選挙期間中に悪用され、民主的プロセスを腐敗させる可能性がある点を指摘しています。

ヒントンはAIの規制と慎重な利用を奨励している一方で、その将来についての論争が続いていることを認めています。技術の進歩が人類の利益に役立つようにするためには、AIの潜在力を活用しつつ、そのリスクを最小限に抑えるバランスが重要です。

よくある質問(FAQ)

1. ジェフリー・ヒントンによると、AIに関連する主なリスクは何ですか?

– ジェフリー・ヒントンは、AIが誤情報を拡散し、雇用市場を混乱させ、存立上の脅威を提起し、サイバー犯罪に悪用される可能性について懸念を表明しています。

2. AIのニューラルネットワークは人間の認知とどのように異なりますか?

– 人間の脳をモデルにしたニューラルネットワークは、人工ニューロン間の接続を作成して情報を処理および伝送します。このプロセスは、人間の記憶や合理的な応答や出力を生成する能力と類似しています。

3. AIの影響は雇用の安定性にどのように影響しますか?

– AIが雇用に与える将来の影響はまだ不確実ですが、AIアルゴリズムによってルーチンな知的労働が影を落とされ、雇用の置き換えや潜在的な不平等が生じる可能性があります。

4. サイバーセキュリティはAIによってどのように影響を受けますか?

– AIモデルのオープンソース化はリスクを伴います。サイバー犯罪者はこれらのモデルを悪用し、サイバー犯罪やフィッシング攻撃などの犯罪行為に利用する可能性があります。

5. AIによる民主的プロセスへの潜在的な危険性は何ですか?

– 偽画像、ビデオ、音声を生成するAIの進化は、選挙期間中に民主的プロセスを操作または腐敗させるために悪用される可能性について懸念が持たれています。

The source of the article is from the blog rugbynews.at