Dario Amodei, cofondateur d’Anthropic, partage ses inquiétudes concernant le développement de l’IA

Dans un domaine en pleine expansion, Dario Amodei, le cofondateur d’Anthropic et ancien membre d’OpenAI, exprime son malaise quant à l’avenir de l’intelligence artificielle (IA). Ses préoccupations découlent du potentiel pour l’IA de devenir autoréplicante et autonome dans l’année à venir. L’appréhension concerne non seulement les capacités de l’IA, mais aussi son utilisation potentielle.

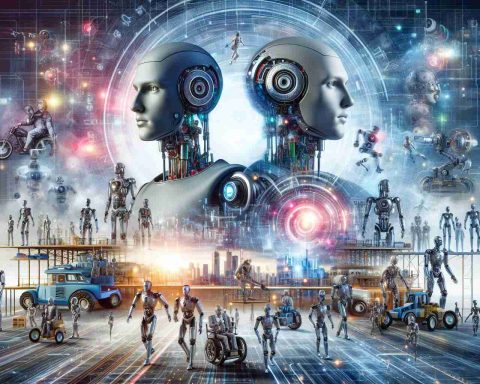

Réalités de l’IA à la Terminator

Le scénario peut rappeler la série de films « Terminator », avec des robots faisant la guerre à l’humanité. Cependant, Amodei met en garde contre le fait qu’une IA aussi puissante et autonome pourrait bientôt devenir réalité. Après avoir pris des chemins différents avec OpenAI en raison d’un désaccord philosophique, Amodei a fondé Anthropic, visant à créer un modèle linguistique éthique et sécurisé. Dans cette démarche, il a élaboré les Niveaux de Sécurité de l’IA (ASL) pour évaluer les dangers potentiels des intelligences artificielles, dotant le chatbot Claude d’Anthropic de couches de sécurité bien définies.

Avancer vers des niveaux de sécurité de l’IA plus élevés

Classés actuellement au niveau ASL 2, les modèles d’IA sont associés à un risque modéré. Cependant, la vision d’Amodei suggère que nous pourrions passer au niveau ASL 4 d’ici 2025. À ce niveau, les IA auraient la capacité d’interagir de manière convaincante avec les humains et de fonctionner de manière autonome. La préoccupation pour Amodei ne porte pas tant sur la technologie elle-même que sur la manière dont elle pourrait être exploitée.

L’IA entre les mains des régimes autoritaires

Il craint notamment l’adoption de l’IA par des États autoritaires ou des dictatures comme la Chine, la Russie ou la Corée du Nord, où elle pourrait accentuer la puissance militaire et la domination régionale. Les positions éthiques et les prises de conscience collectives au sein de la communauté de l’IA varient, soulevant des préoccupations quant à l’approche unifiée de ces avancées. Amodei espère que ses inquiétudes s’avéreront infondées, mais seul le temps dira l’histoire de la trajectoire de l’IA et de son impact sur la société mondiale.

Questions importantes et réponses associées :

– Quels sont les dangers potentiels de l’autonomisation et de l’autoréplication de l’IA ?

Les systèmes IA autonomes et autoréplicatifs pourraient fonctionner au-delà du contrôle humain, posant des risques tels que des conséquences non voulues, des problèmes éthiques liés à des décisions prises sans surveillance humaine et l’amplification des capacités militaires dans les régimes autoritaires.

– Comment les niveaux de sécurité de l’IA (ASL) peuvent-ils contribuer au développement d’une IA sûre ?

Les Niveaux de Sécurité de l’IA fournissent un cadre structuré pour évaluer les risques liés aux systèmes IA. Cela peut guider le développement des IA pour garantir que des mesures éthiques, des dispositifs de sécurité et des mécanismes de contrôle sont en place à mesure que les capacités de l’IA augmentent.

– Quels sont les problèmes éthiques associés au développement de technologies IA avancées ?

Les préoccupations éthiques incluent les droits à la vie privée, les biais dans la prise de décision par l’IA, la perte d’emplois en raison de l’automatisation et le potentiel de mauvaise utilisation ou d’abus de l’IA par des acteurs malveillants ou des gouvernements oppressifs.

– Existe-t-il une approche unifiée au sein de la communauté de l’IA pour aborder les risques liés à l’IA ?

Il n’existe pas une seule approche cohésive, car les points de vue sur l’éthique de l’IA et les mesures de sécurité varient au sein de la communauté. La collaboration et l’établissement de normes et de réglementations internationales sont essentiels pour atténuer les risques.

Principaux défis ou controverses :

L’un des principaux défis est d’équilibrer le développement de la technologie IA avec les considérations éthiques et les mesures de sécurité pour prévenir les abus. Il existe une controverse sur l’attribution des responsabilités morales et éthiques pour les actions de l’IA, et le potentiel d’une course aux armements en IA entre les nations, qui pourrait conduire à une augmentation des systèmes d’armes autonomes. La réglementation et la supervision sont des sujets controversés, car des mesures trop strictes pourraient étouffer l’innovation, alors que des mesures laxistes pourraient entraîner un développement non contrôlé.

Avantages et inconvénients :

Les avantages du développement de technologies IA autonomes incluent :

– Une amélioration de l’efficacité et de la productivité dans divers secteurs tels que la fabrication, le transport et la santé.

– Une meilleure précision et constance dans l’exécution de tâches nécessitant traditionnellement une main-d’œuvre humaine.

– Des avancées dans la résolution de problèmes complexes, conduisant à des innovations et à de nouvelles découvertes.

Les inconvénients de ces technologies sont :

– Le potentiel de déplacement des travailleurs humains, entraînant des défis économiques et sociaux.

– Les risques de développement de technologies pouvant être utilisées à des fins malveillantes, y compris la surveillance et les armes autonomes.

– Des difficultés à établir une gouvernance efficace et des lignes directrices éthiques qui accompagnent les avancées technologiques.

Liens suggérés :

Pour en savoir plus sur la sécurité et l’éthique de l’IA, vous pouvez envisager de visiter les sites officiels suivants :

– OpenAI

– Anthropic

– Pour une perspective plus large sur les politiques en matière d’IA, Future of Life Institute discute souvent des préoccupations de sécurité de l’IA.

Assurez-vous de ne visiter que des sources officielles et crédibles pour obtenir des informations sur un domaine aussi crucial et évolutif que l’intelligence artificielle.