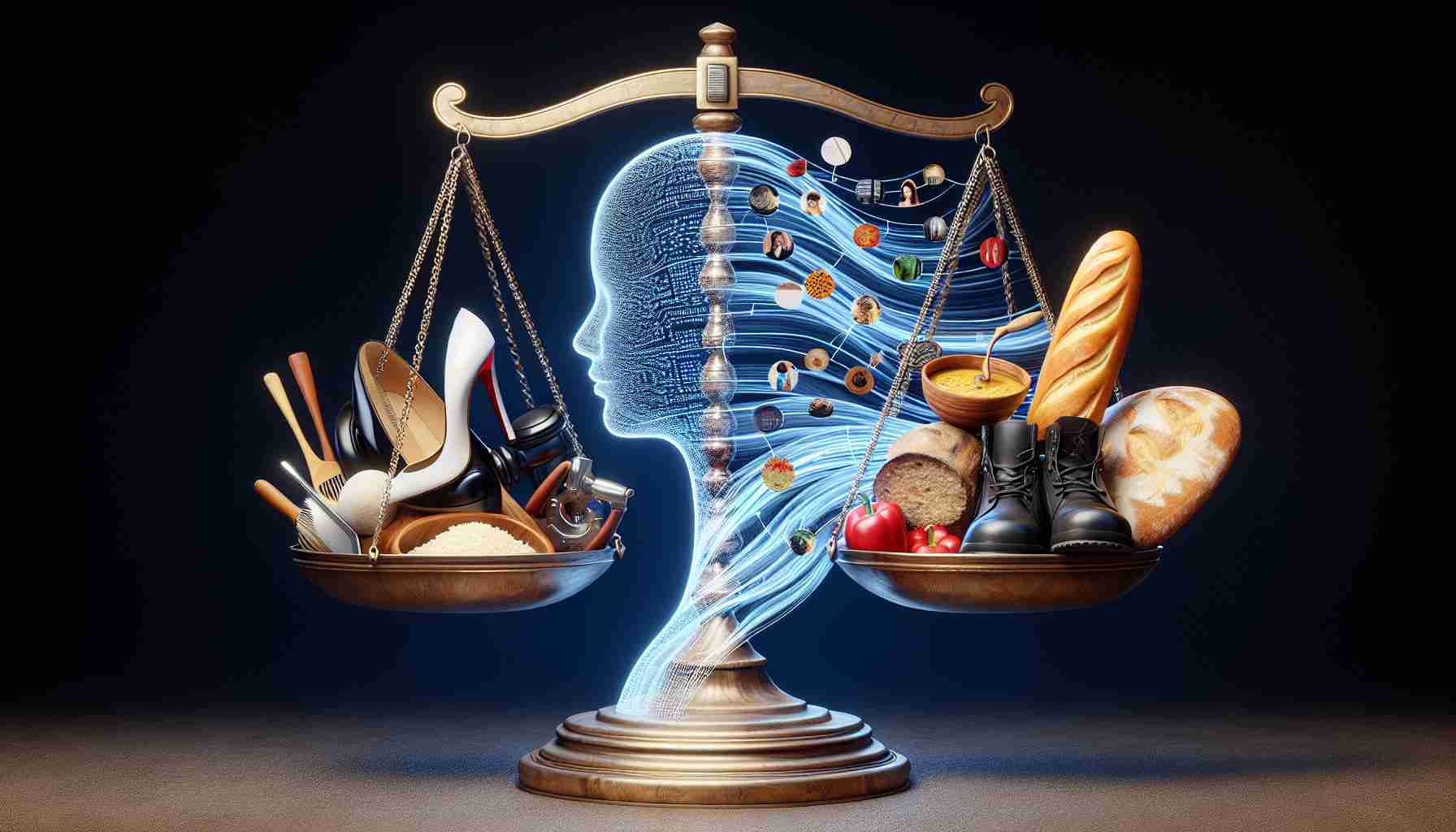

هوش مصنوعی (AI) به جزئی اساسی از زندگی روزمره ما تبدیل شده است و تأثیرگذار بر همه چیز از تصمیمگیریهای مالی تا تعاملات رسانههای اجتماعی ماست. فناوری هوش مصنوعی، مانند پاسخهای ارائهشده توسط چتباتها یا قابلیتهای دیدهشده در سیستمهای پیشرفته مانند ChatGPT، اغلب نادیده گرفته میشود. با این حال، زیر سطح فنیل خود که به عنوان بیطرفی شناخته میشود، یک شبکه پیچیده از پیامدهای اجتماعی، شامل انحیزهای مختلف بر اساس نژاد، فرهنگ و جنسیت، قرار دارد.

یک گزارش اخیر از سازمان ملل متحد، که در تاریخ 7 مارس منتشر شد، تبعیضهای جامد در ابزارهای پردازش زبان طبیعی که پایههای امروزی بسیاری از پلتفرمهای پر تولید هوش مصنوعی را تشکیل میدهند، را برجسته کرد. گزارش بر این موضوع تأکید کرد که خروجیهای هوش مصنوعی اغلب انحیزهای جنسی را تکرار میکنند. تحقیقات نقشهای تبعیضآمیز را زمانی که از هوش مصنوعی خواسته شد که داستانهایی درباره افراد ایجاد کند، نشان داد که مردان بیشتر به نقشهای پرستیژیوز مثل استادان، مهندسان و پزشکان تعلق میگیرند، در صورتی که زنان اغلب به نقشهای استریوتیپی مثل آشپزان، خدمتکاران خانه یا حتی راستابازان منتقل میشدند.

کارشناسان در این حوزه تأکید میکنند که انحیزهای هوش مصنوعی نقشه حضوری در جامعه را دارند – دادهای که از آن یاد میگیرد از تفاوتهای اجتماعی موجود تحت تأثیر است. مایلن گارسیا، یک جامعشناس و همراه بنیاد انجیاوی دادههای جنسی، بر جنبههای گشنیزداری داده و در انجمنی سازماندهی شده توسط گارسیا، همراه با ایوانا فلدفبر و یاسمین کویروگا، دادهها را از زاویه جنسی بررسی میکند و به دنبال رفع عدم تعادل و ناحیههای بیشگونی میباشد.

یکی از پروژههای معتبر آنها، Aymurai، دادههای مرتبط با خشونت بر مبنای جنسیتی را از رأیگیریهای قضایی جمعآوری و در دسترس قرار میدهد. این تلاش در سیستم حقوقی شهر خودمختار بوئنوس آیرس آغاز شد و با آرزوهای گسترش این ابزار به ادارات قضایی مختلف همراه است. توانایی هوش مصنوعی برای ناشناس کردن اطلاعات حساس در اسناد دادگاهی مورد توجه خاصی قرار گرفته است، این امر تحقیقات جامعی در خصوص خشونت علیه زنان را امکانپذیر مینماید.

کارشناسان برای تیمهای توسعه نرمافزار هوش مصنوعی، تحت الفت را مورد تأکید قرار میدهند، این امر نشاندهنده این است که بیشتر طراحیها تاریخچه از گروه یکرفت همگن به سرخپوستان از شمال جهان داشته باشند، که اغلب از تجربیات شخصی تبعیض یاد نمیکنند. این کمبود تنوع ممکن است منجر به فناوریها شود که نتواند در نظر گرفتن دیدگاههای جنسیتی و نیازهای گستردهای از جامعه را فراهم کند.

بحث در مورد هوش مصنوعی به چالشها و معضلات فراتر از چالشهای فناوری میرود و حائز اهمیت بررسیهای قضایی و اخلاقی است، که تأکید میشود تنظیمات و مداخلات هدفمند برای اطمینان از توسعه و استفاده از هوش مصنوعی بیانحیاز و انصافی اهمیت دارد.

The source of the article is from the blog regiozottegem.be