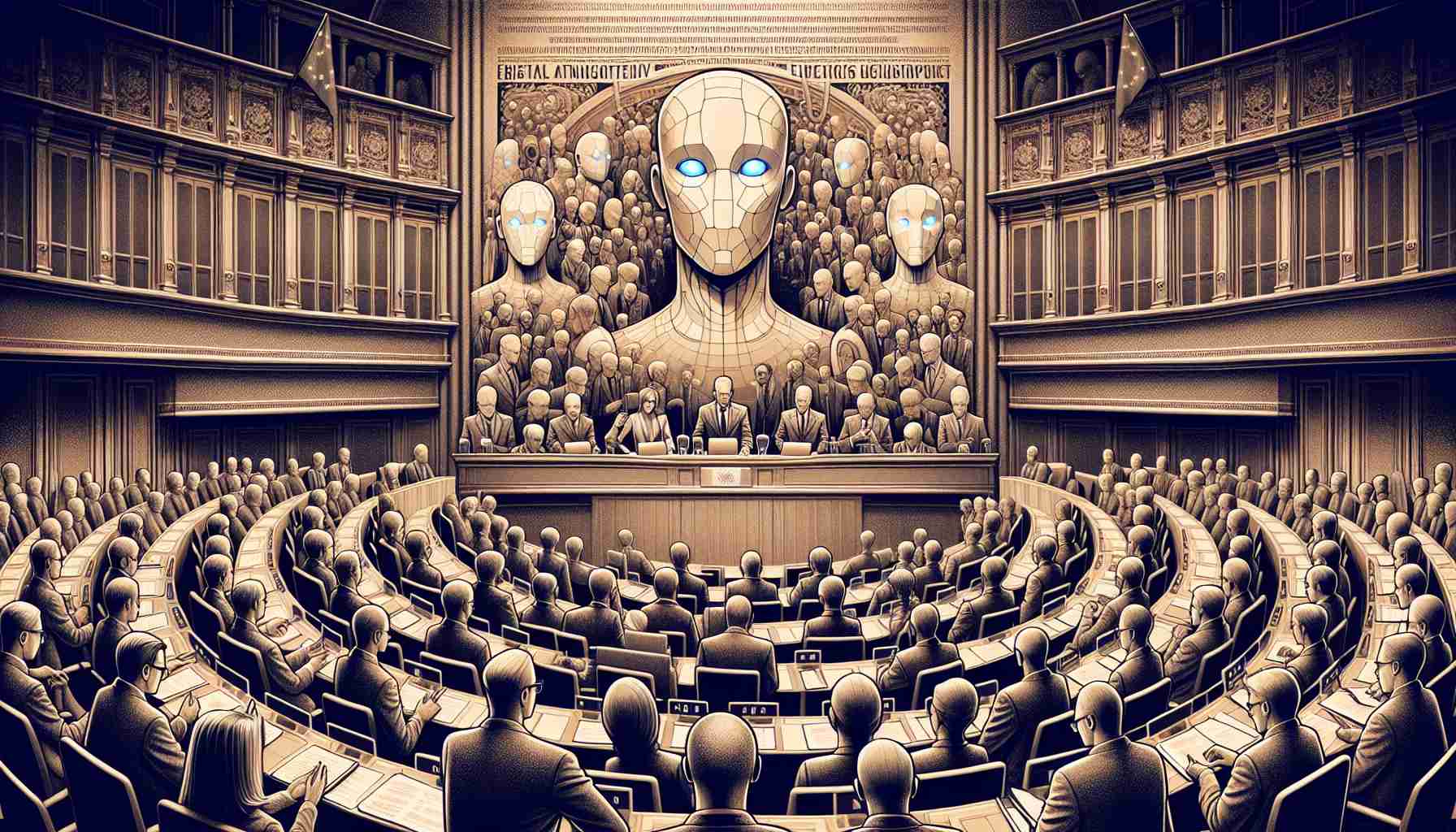

Europæiske lovgivere står klar til at indføre omfattende reguleringer, der styrer feltet for kunstig intelligens, herunder systemer som OpenAI’s ChatGPT. De foreslåede regler, der først blev introduceret i 2021, sigter mod at finde en balance mellem at beskytte borgerne mod potentielle risici og fremme innovation.

Den seneste lancering af OpenAI’s ChatGPT, understøttet af Microsoft, har vakt bred interesse for udviklingen af AI-software. Dog er der også opstået bekymringer om potentiel misbrug og negative konsekvenser. For at imødekomme behovet for tilsyn, tager EU’s “AI Act” en risikobaseret tilgang og pålægger strengere krav til højrisiko AI-systemer.

Under disse reguleringer skal udbydere af højrisiko AI-teknologier gennemføre grundige risikovurderinger og sikre, at deres produkter overholder loven, før de gøres tilgængelige for offentligheden. EU’s kommissær for det indre marked, Thierry Breton, understregede, at tilgangen taget af reguleringerne er proportionel og fokuseret på at minimere unødvendig regulering samtidig med at sikre ansvarlig udrulning af AI.

EU’s “AI Act” har opnået bred anerkendelse og placerer Europa som global leder inden for troværdig AI. Dragos Tudorache og Brando Benifei, medlemmer af Europa-Parlamentet, kæmpede med succes for lovgivningens vedtagelse, og Tudorache fejrede EU’s rettidige handling ved at udtale: “EU leverede. Ingen ‘hvis’ og ingen ‘men’ senere.”

Overtrædelse af reguleringerne kan resultere i betydelige bøder på mellem 7,5 millioner og 35 millioner euro ($8,2 millioner til $38,2 millioner), afhængigt af overtrædelsens art og virksomhedens størrelse. Reglerne forbyder eksplicit brugen af AI til forudsigende politiarbejde samt systemer, der udnytter biometriske oplysninger til at konkludere følsomme personlige egenskaber som race, religion eller seksuel orientering.

Reguleringerne begrænser også genkendelse af ansigter i realtid på offentlige steder, med undtagelser givet til politiet. Dog skal politiet selv i disse tilfælde anmode om godkendelse fra en retlig myndighed, før de udruller AI-systemer. Denne tilgang finder en balance mellem hensyn til offentlig sikkerhed og beskyttelse af individuelle privatlivsrettigheder.

Efter godkendelse i parlamentet forventes de 27 medlemslande i EU at forme reguleringerne formelt i april. Loven vil efterfølgende blive offentliggjort i EU’s officielle journal i maj eller juni. Bestemmelserne specifikke for AI-modeller som ChatGPT træder i kraft 12 måneder efter lovens officielle offentliggørelse, mens de fleste andre regler vil have en toårig overholdelsestidslinje.

Den transformative potentiale af AI i forskellige aspekter af europæernes liv, kombineret med den intense konkurrence blandt store teknologivirksomheder på det lukrative AI-marked, har ført til omfattende lobbyindsats. Franske AI-startup Mistral AI, Tysklands Aleph Alpha og amerikanske tech-giganter som Google og Microsoft har alle forsøgt at påvirke reguleringerne. Indflydelsen af virksomhedens lobbyarbejde under disse forhandlinger har rejst bekymringer blandt tilsynsgrupper, som understreger behovet for klarhed og gennemsigtighed vedrørende standarder, tærskler og andre forpligtelser.

Kommissær Breton har understreget EU’s engagement i at modstå virksomhedspres for at undtage store AI-modeller fra reguleringer. Han karakteriserede den resulterende “AI Act” som et afbalanceret, risikobaseret og fremtidssikret rammeværk. Dog har nogle tech-lobbygrupper som CCIA givet udtryk for bekymringer om visse bestemmelser, idet de hævder, at de forbliver uklare og kan hæmme udviklingen og udrulningen af innovative AI-applikationer i Europa.

For at sikre en vellykket implementering af reguleringerne vil det være afgørende at finde en fin balance mellem at opretholde et blomstrende og dynamisk AI-marked samtidig med at pålægge nødvendige sikkerhedsforanstaltninger. Kun gennem omfattende og omhyggelig udførelse kan EU sikre, at reglerne hverken tynger virksomheder eller hindrer deres evne til at innovere og konkurrere effektivt.

FAQ

Hvad er “AI Act”?

“AI Act” refererer til hele sættet af regler foreslået af EU-lovgivere for at styre kunstig intelligens, herunder systemer som OpenAI’s ChatGPT. Det sigter på at beskytte borgerne mod potentielle risici forbundet med AI og samtidig fremme innovation.

Hvad er nøgleelementerne i “AI Act”?

“AI Act” tager en risikobaseret tilgang og pålægger strengere krav for højrisiko AI-systemer. Udbydere af højrisiko AI skal gennemføre risikovurderinger og sikre overholdelse af loven, før de gør deres produkter tilgængelige for offentligheden. Reglerne forbyder også brugen af AI til forudsigende politiarbejde og systemer, der bruger biometriske oplysninger til at konkludere følsomme personlige egenskaber.

Hvad er bøderne for ikke-overholdelse?

Overtrædelser af “AI Act” kan resultere i bøder på mellem 7,5 millioner og 35 millioner euro ($8,2 millioner til $38,2 millioner), afhængigt af overtrædelsens art og virksomhedens størrelse.

Hvad er de vigtigste bekymringer rejst af tilsynsgrupper?

Tilsynsgrupper har udtrykt bekymring over potentiel svækkelse af reguleringerne på grund af virksomhedens lobbyindsats. De understreger også behovet for yderligere afklaring om forskellige aspekter som standarder, tærskler og transparensforpligtelser.

Hvad er tidslinjen for implementeringen?

Efter godkendelse i parlamentet forventes de 27 medlemslande i EU at forme reguleringerne formelt i april. Loven vil blive offentliggjort i EU’s officielle journal i maj eller juni. Bestemmelserne specifikke for AI-modeller som ChatGPT træder i kraft 12 måneder efter lovens officielle offentliggørelse, mens de fleste andre regler vil have en toårig overholdelsestidslinje.

The source of the article is from the blog bitperfect.pe