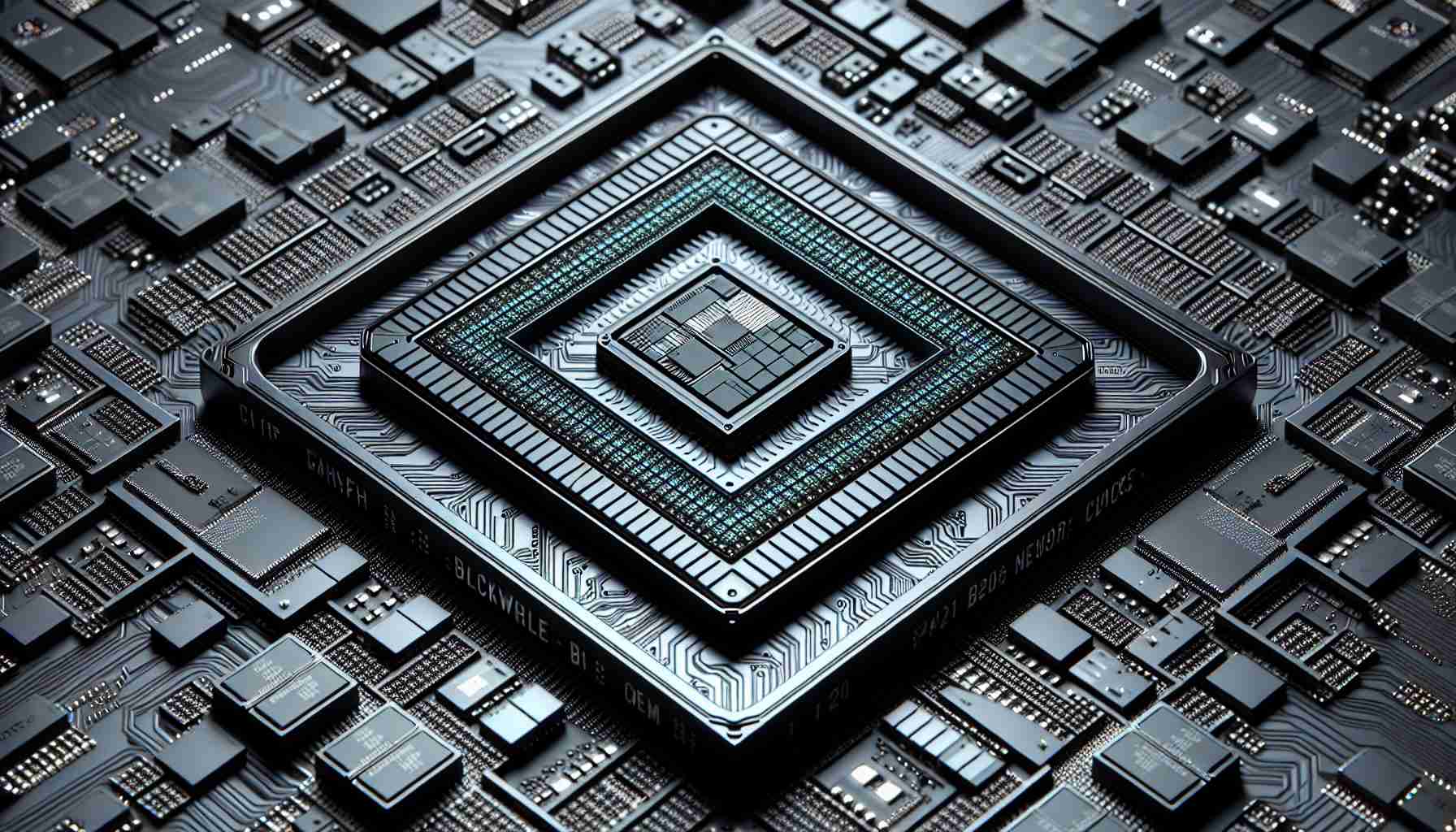

Die jüngste Enthüllung von Nvidia über den Blackwell B200 Tensor Core Chip hat die Aufmerksamkeit der Branche auf sich gezogen. Der Chip wird als der leistungsstärkste Einzelchip-GPU gepriesen und verfügt über beeindruckende 208 Milliarden Transistoren. Nvidia behauptet, dass der Blackwell B200 die Betriebskosten für AI-Inferenz um bis zu 25 Mal im Vergleich zu seinem Vorgänger, dem H100, reduzieren kann. Diese Weiterentwicklung hat das Potenzial, das AI-Computing zu revolutionieren und für eine Vielzahl von Anwendungen zugänglicher zu machen.

Ein Schlüsselhighlight der Ankündigung von Nvidia ist die Einführung des GB200 „Superchips“. Dieser Superchip kombiniert zwei B200-Chips mit einem Grace-CPU, um noch höhere Leistungen zu erzielen. Er ist speziell für fortschrittliche KI-Anwendungen und Aufgaben konzipiert, die erhebliche Rechenleistung erfordern. Die Kombination der B200-Chips und der Grace-CPU eröffnet neue Möglichkeiten für die KI-Entwicklung und Forschung.

In Bezug auf die Markteinführung haben eine Reihe von großen Organisationen ihr Interesse bekundet, die Blackwell-Plattform zu übernehmen. Branchengrößen wie Amazon Web Services, Dell Technologies, Google, Meta, Microsoft, OpenAI, Oracle, Tesla und xAI haben alle Interesse gezeigt, diese leistungsstarke Technologie für ihre KI-basierten Operationen zu nutzen. Die Unterstützung von Tech-CEOs wie Mark Zuckerberg und Sam Altman validiert zusätzlich das Potenzial der Plattform.

Der Erfolg von Nvidias GPUs auf dem KI-Markt ist auf ihre massiv parallele Architektur zurückzuführen, die die für neuronale Netzwerke erforderlichen Matrixmultiplikationen beschleunigt. Diese Architektur wurde zunächst für Gaming-Zwecke entwickelt, fand aber auch im KI-Computing großen Erfolg. Tatsächlich hat der Umsatz von Nvidias Rechenzentren (18,4 Milliarden US-Dollar) den Umsatz mit Gaming-GPUs (2,9 Milliarden US-Dollar) bei weitem übertroffen.

Häufig gestellte Fragen (FAQ)

The source of the article is from the blog girabetim.com.br