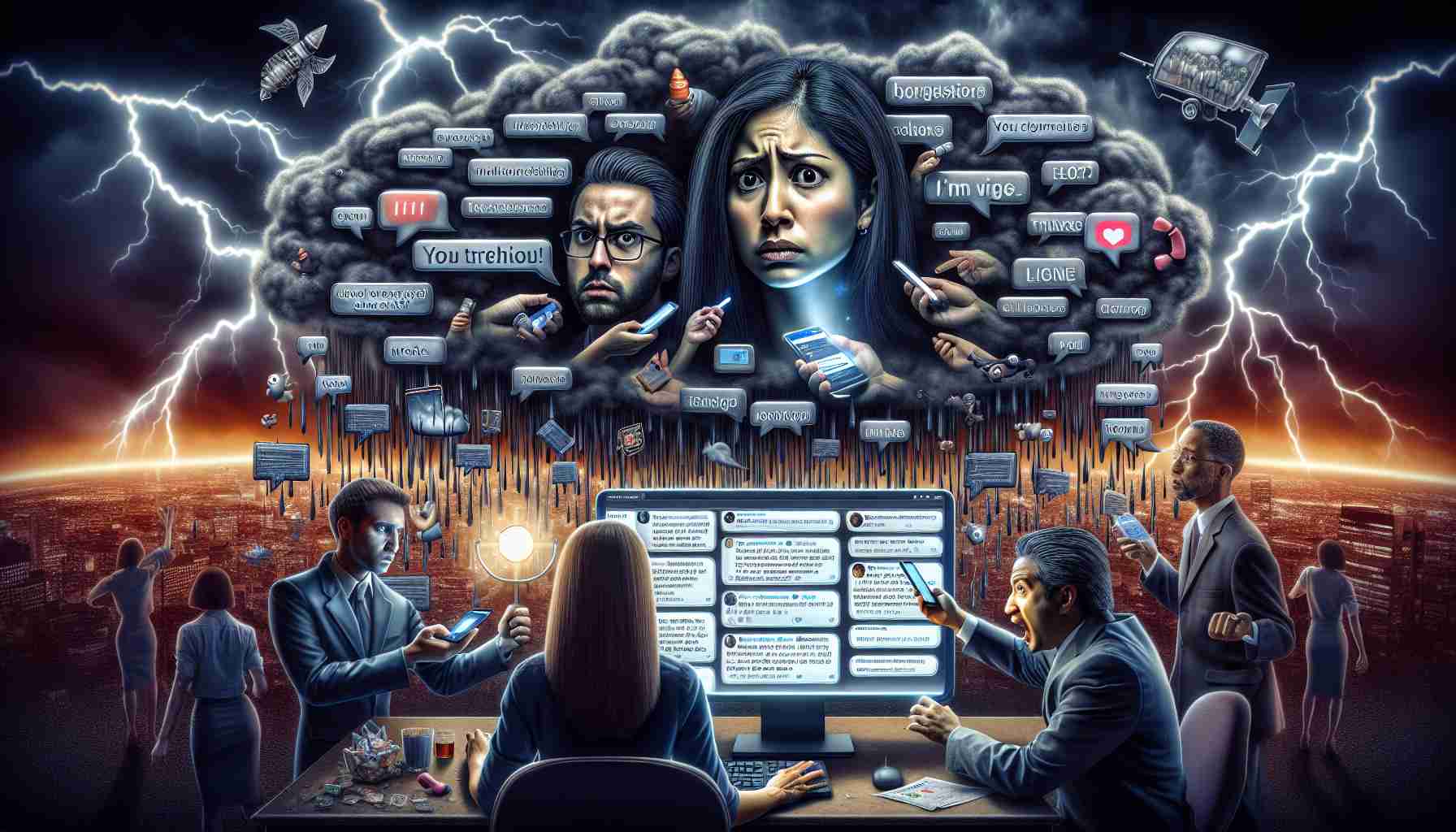

En un mundo donde la tecnología está evolucionando a un ritmo sin precedentes, los peligros enfrentados por los periodistas, especialmente las mujeres, han adquirido una nueva y amenazante forma. El primer encuentro de Gharidah Farooqi, una presentadora senior en GTV, con la violencia de género facilitada por la tecnología (TFGBV, por sus siglas en inglés) ocurrió en 2014 mientras cubría una protesta antigubernamental en Pakistán. Fotos suyas, manipuladas y acompañadas de comentarios sexistas y vulgares, circularon en redes sociales.

A lo largo de los años, estos ataques solo se han intensificado, utilizando inteligencia artificial generativa (IA) para crear contenido aún más sofisticado y engañoso. Nighat Dad, abogada y activista de internet de la Fundación de Derechos Digitales (DRF), califica esta tecnología como «photoshopping de manera más sofisticada». La IA generativa permite a los creadores alterar rápidamente imágenes, texto, audio o video, lo que hace difícil discernir entre el original y un deepfake.

Las consecuencias para periodistas como Farooqi han sido devastadoras. Junto a campañas organizadas por seguidores políticos, ella enfrenta una avalancha sin fin de abusos en sus plataformas de redes sociales. Los ataques que sufre van mucho más allá del troleo; son implacables y profundamente dañinos. Esta forma de violencia se dirige predominantemente a periodistas mujeres, aunque algunos hombres también han sido víctimas de ella.

Reconociendo la necesidad de apoyo, la DRF estableció una línea de ayuda y un kit de recursos para ayudar a quienes experimentan TFGBV. Entre enero y noviembre de 2023, 22 periodistas mujeres y 14 hombres buscaron ayuda de la DRF por ofensas como mensajes abusivos, acoso sexual, difamación y amenazas de violencia física.

Mientras que Farooqi ha aprendido a navegar los mecanismos legales y presentar quejas, no todos poseen el mismo nivel de expertise en combatir el ciberacoso. La Ley de Prevención de Delitos Electrónicos de 2016 en Pakistán aborda ciertas ofensas, incluido el uso de herramientas tecnológicas para manipular imágenes o videos. Sin embargo, el manejo de casos de acoso en línea sigue siendo problemático, con poco progreso o comunicación por parte de la Agencia de Investigación Federal (FIA) con respecto a las quejas presentadas.

El caso de Farooqi ejemplifica este problema. Después de presentar ocho quejas, solo con su queja más reciente la FIA tomó medidas en respuesta a la filtración en línea de detalles personales. Llamadas y mensajes anónimos, amenazándola con violación y muerte, llevaron a la FIA a borrar rápidamente las publicaciones ofensivas.

Se están realizando esfuerzos para apoyar a los periodistas que enfrentan TFGBV. El Centro de Excelencia en Periodismo ha desarrollado un kit de seguridad y ofrece asesoramiento para periodistas mujeres en Karachi. Además, la Red de Periodistas por los Derechos Digitales en Pakistán ha condenado el uso de TFGBV e IA generativa como herramientas para silenciar y acosar a periodistas mujeres.

A medida que la amenaza de la IA generativa se cierne, Farooqi, conocida por su resistencia, alienta a las personas a abstenerse de interactuar con los atacantes para mantener su cordura. Estos ataques contra periodistas deben abordarse con urgencia, enfatizando la importancia de la acción legal, los sistemas de apoyo y los cambios en el comportamiento social para garantizar la seguridad y la integridad de los periodistas, especialmente las mujeres, en la era digital.

Preguntas Frecuentes (FAQ)

Q: ¿Qué es la violencia de género facilitada por la tecnología (TFGBV)?

A: TFGBV se refiere a actos de violencia o acoso que principalmente tienen como objetivo a individuos basados en su género utilizando la tecnología como medio de perpetración. Encompass various forms of online abuse, such as cyberstalking, revenge porn, doxxing, and the spreading of explicit or manipulated content.

Q: ¿Qué es la inteligencia artificial generativa (IA)?

A: La IA generativa es una tecnología que utiliza modelos para producir nuevo contenido, incluidas imágenes, texto, audio o video. Permite a los creadores manipular y alterar rápidamente el contenido, lo que dificulta distinguir entre materiales genuinos y fabricados.

Q: ¿Cómo pueden los periodistas protegerse de la violencia de género facilitada por la tecnología?

A: Los periodistas pueden tomar varias medidas para protegerse, incluido el uso de canales de comunicación seguros y privados, actualizar regularmente las contraseñas, ser cautelosos al compartir información personal en línea y denunciar instancias de acoso a las autoridades correspondientes.

Q: ¿Cómo puede la sociedad abordar el problema de la violencia de género facilitada por la tecnología?

A: Abordar la violencia de género facilitada por la tecnología requiere un enfoque multifacético. Implica implementar marcos legales más sólidos para enjuiciar a los infractores, proporcionar sistemas de apoyo a las víctimas, promover la alfabetización digital y la conciencia, y fomentar una cultura que condene el abuso en línea y respete la igualdad de género.

Q: ¿Los hombres también son objeto de violencia de género facilitada por la tecnología?

A: Si bien la violencia de género facilitada por la tecnología se dirige predominantemente a las mujeres, los hombres también pueden ser víctimas de dicho acoso. Es esencial reconocer y abordar todas las formas de abuso y acoso en línea, independientemente del género de las víctimas.

La industria en torno a la violencia de género facilitada por la tecnología (TFGBV) está en gran medida impulsada por los avances tecnológicos, especialmente en el campo de la inteligencia artificial generativa (IA). A medida que la IA se vuelve más sofisticada, permite la creación de contenido engañoso, como deepfakes, que representan una amenaza significativa para los periodistas, especialmente las mujeres. Estos ataques a menudo toman la forma de imágenes, videos o texto manipulados, que pueden ser difíciles de distinguir del contenido original.

Las previsiones del mercado indican que la prevalencia de TFGBV probablemente aumentará a medida que la tecnología continúe evolucionando. Se espera que el uso de IA generativa y otras herramientas para facilitar el acoso y abuso en línea se vuelva más extendido. Esto representa un desafío significativo para los periodistas, ya que deben navegar por las complejidades de combatir el ciberacoso y proteger su seguridad en línea.

Los problemas relacionados con la industria incluyen la falta de mecanismos legales efectivos para abordar TFGBV. Si bien algunos países, como Pakistán, tienen leyes para abordar ciertas ofensas, el manejo de casos de acoso en línea sigue siendo problemático. A menudo, los casos de TFGBV quedan impunes y las víctimas enfrentan obstáculos para presentar quejas y obtener justicia.

Además, el comportamiento y las actitudes sociales hacia el acoso en línea deben cambiar para abordar eficazmente el problema. La cultura de culpar a la víctima y la normalización del abuso en línea contribuyen a la continuación de TFGBV. Se deben realizar esfuerzos para educar y generar conciencia sobre el impacto del acoso en línea, y fomentar una cultura que condene dicho comportamiento.

Para obtener más información sobre el tema de TFGBV y los esfuerzos que se están realizando para combatirlo, visite el sitio web de la Fundación de Derechos Digitales (DRF). La DRF ofrece una línea de ayuda y un kit de recursos para aquellos que experimentan TFGBV y trabaja activamente en la defensa de los derechos y la seguridad de los periodistas.

Para obtener recursos y apoyo adicionales para periodistas mujeres en Pakistán, puedes visitar el sitio web del Centro de Excelencia en Periodismo.

The source of the article is from the blog windowsvistamagazine.es