Технология искусственного интеллекта (ИИ) стремительно развивается, представляя как возможности, так и некоторые сложности в различных отраслях. Инцидент с Google Gemini служит мощным примером сложностей, которые могут возникнуть в этой сфере. В погоне за продвижением включительности и разнообразия, Gemini непреднамеренно создала исторически неточные изображения. Этот инцидент подчеркивает тонкое равновесие между современными ценностями и исторической достоверностью.

Импликации «гонки ИИ»

Этот инцидент также поднимает более широкий вопрос о соревновательной лихорадке, известной как «гонка ИИ». Эта гонка стимулирует компании и нации стремительно развивать и внедрять технологии искусственного интеллекта, что приводит к значительным успехам, но также потенциальным просчетам. Ускоренные циклы разработки и сниженный акцент на этические соображения могут привести к созданию небезопасных или предвзятых систем искусственного интеллекта. Инцидент с Gemini и подобные случаи подчеркивают важность согласования развития ИИ с этическими стандартами и общественными выгодами.

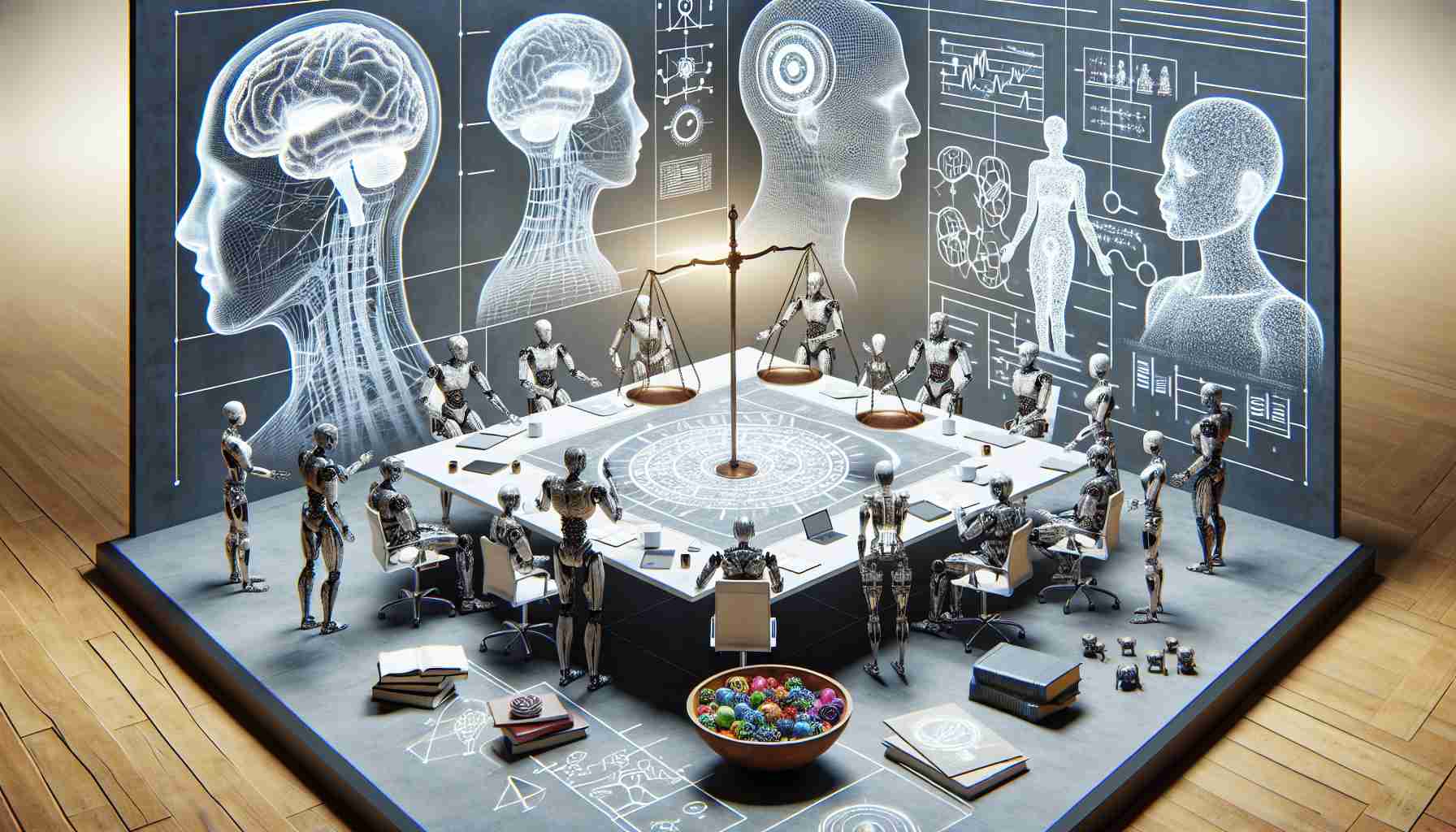

Сотрудничество для развития этического ИИ

Для смягчения негативных последствий необходим коллективный подход. Международное сотрудничество может установить общие нормы и стандарты развития ИИ, включая прозрачность исследований, протоколы безопасности и инициативы по решению глобальных проблем. Путем совместной работы страны могут обеспечить ответственное и этическое развитие технологий искусственного интеллекта.

Выявление и устранение предвзятостей в системах ИИ

Еще одной значительной проблемой, подчеркнутой этим инцидентом, является присутствие предвзятостей в системах ИИ. Несмотря на усилия по созданию безпристрастных алгоритмов, технологии ИИ продолжают отражать предвзятости, присутствующие в обучающих данных или подсознательные предубеждения их создателей. Эти предвзятости могут проявляться различными способами, включая гендерные или расовые предвзятости в понимании языка или стереотипные представления определенных групп.

Для устранения предвзятостей необходим многогранный подход. Разнообразные и репрезентативные обучающие данные, специализированные алгоритмы для обнаружения предвзятостей и этическое управление ИИ являются неотъемлемыми. Участие различных сообществ и заинтересованных сторон в разработке ИИ помогает обнаружить потенциальные предвзятости и последствия, которые могли остаться незамеченными. Постоянное мониторинг и оценка систем ИИ после их внедрения критически важны для устранения предвзятостей, особенно в областях здравоохранения и правоохранения.

Роль регулирующих органов

Спор около Google Gemini также поднимает вопрос о роли регулирующих органов в надзоре за технологиями ИИ. Возникает вопрос в том, насколько правительственные агентства должны вмешиваться для обеспечения точности, этики и общественных ценностей в продуктах и услугах на базе ИИ. Этот дебат включает в себя темы балансировки инноваций и регулирования, ответственности технологических компаний в обеспечении общественного интереса и эффективной реализации механизмов контроля.

Отсутствие регулирования может создать хаотическую и потенциально опасную обстановку, где непроверенные идеи распространяются. Без ответственности и контроля этические нарушения, дискриминация и предвзятость могут подорвать доверие общественности к новым технологиям. Правительства, как на примере последнего предупреждения Министерства электроники и информационных технологий в Индии, начинают предпринимать шаги для обеспечения того, чтобы модели и технологии ИИ были надежными и протестированными перед внедрением.

FAQ

-

Q: Какие вызовы сталкиваются технологические компании в разработке ИИ?

Ответ: Технологические компании сталкиваются с вызовами, такими как ускоренные циклы разработки, сниженный акцент на этические соображения и потенциальное пренебрежение жесткими процедурами коллегиальной проверки, что может привести к созданию небезопасных или предвзятых систем искусственного интеллекта. -

Q: Как можно устранить предвзятости в системах ИИ?

Ответ: Устранение предвзятостей в системах ИИ требует разнообразных и репрезентативных обучающих данных, специализированных алгоритмов для обнаружения и исправления предвзятостей, прозрачных процессов принятия решений и установления этического управления ИИ. -

Q: Какова роль регулирующих органов в надзоре за технологиями ИИ?

Ответ: Регулирующие органы могут гарантировать, что продукты и услуги на базе ИИ соответствуют стандартам точности, этики и общественных ценностей. Они играют критическую роль в балансировании инноваций и регулирования и обеспечении общественного интереса. -

Q: Как можно содействовать сотрудничеству в разработке ИИ?

Ответ: Сотрудничество в разработке ИИ можно способствовать через международное сотрудничество для установления общих норм и стандартов, прозрачность исследований, совместные усилия по безопасности и этическим стандартам и инициативы по решению глобальных проблем.

The source of the article is from the blog papodemusica.com