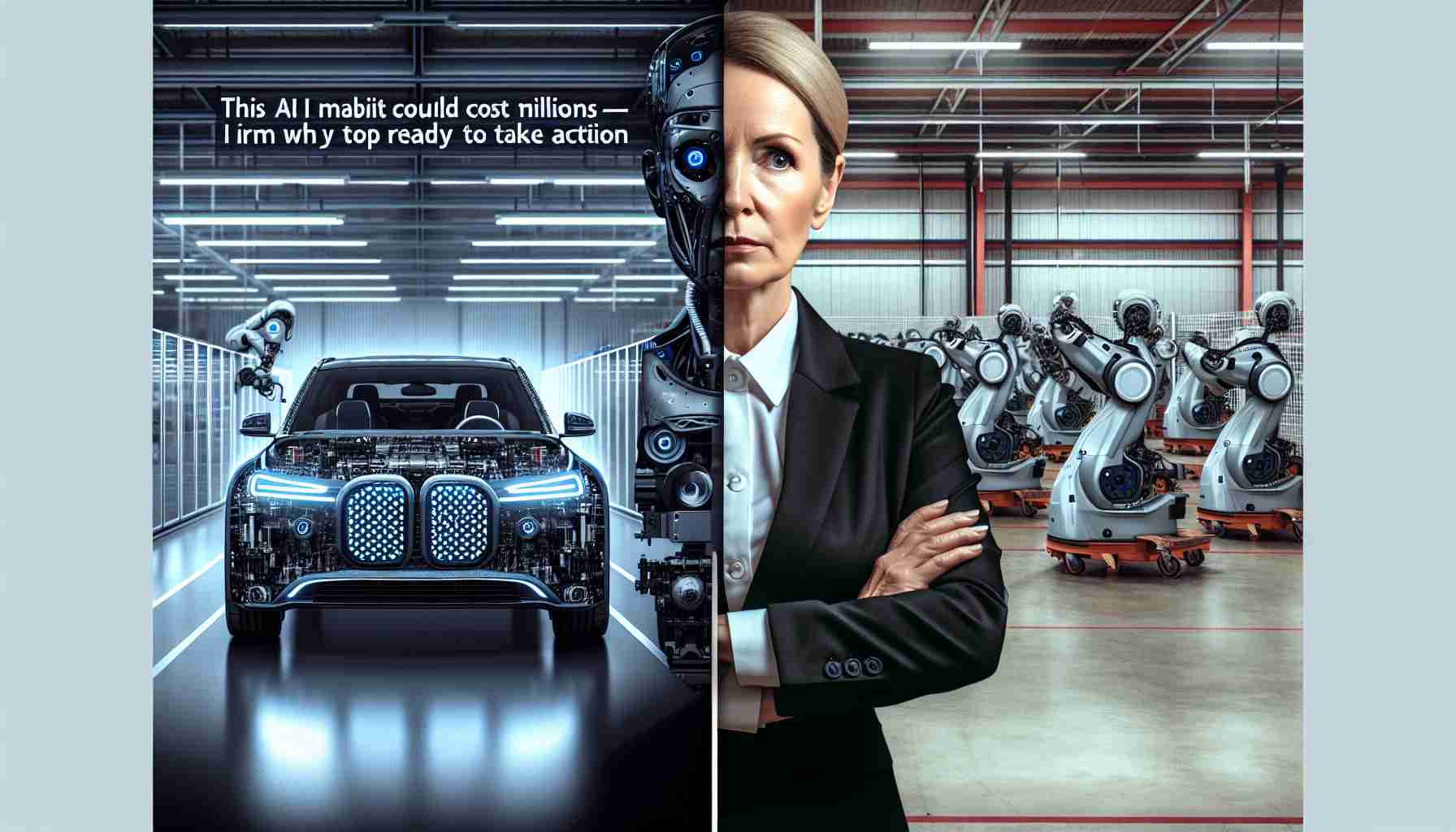

Пристрастие в ИИ предизвиква спорове на голям саммит

По време на неотдавнашния саммит на Fortune за най-влиятелните жени, Кати Видал, ръководител на Патентното и търговско управление на САЩ, с голяма страст критикува ИИ технологията на Tesla за липсата на включителност. Видал, уважаван инженер с дълбока история в развитието на ИИ, сподели своите лични наблюдения относно ИИ в собственото си превозно средство Tesla.

Систематично пристрастие?

Според Видал, ИИ в нейния Tesla погрешно идентифицира всеки пешеходец като висок бял мъж, което тя намира за притеснително и показателно за по-широк проблем в ИИ системите. Въпреки че не беше цитирана директно, тя сподели своето недоволство, подчертавайки недостатъка в способността на ИИ да разпознава правилно разнообразни индивидуалности.

Потенциални финансови последствия за Tesla

Видал изрази силна позиция по този въпрос, като посочи, че е готова да оттегли значителни финансови инвестиции от Tesla, освен ако пристрастията не бъдат коригирани. Тази ситуация подчертава належащия разговор относно ролята на ИИ в продължаването на стереотипите и акцентира върху потенциалните реални последствия от такива пристрастия, особено в водещи технологии като автономните превозни средства на Tesla.

Защита на справедливи политики

На саммита Видал също обсъди своята визия за справедлива политика относно ИИ. Тя подчерта важността на разнообразните гласове при оформянето на политиката, като се противопоставя на неоснователното влияние на големи корпорации. Видал отстоява позицията, че развитието на ИИ трябва да служи на всички по справедлив и отговорен начин.

Призив за колективни действия

Тя насърчи общественото участие в вземането на решения относно политиката на ИИ, подчертавайки ролята, която малките бизнеси и индивидите играят в влиянието на решенията. Призивът на Видал за действие подчерта, че всеки има интерес към бъдещата посока на ИИ, насърчавайки хората активно да участват в оформянето на сводове от политики.

Стратегии за подобряване на включителността на ИИ и намаляване на пристрастията

В светлината на неотдавнашните дискусии на саммита на Fortune за най-влиятелните жени, където Кати Видал подчерта значителни проблеми с пристрастията в ИИ технологията на Tesla, е ясно, че адресирането на пристрастията в ИИ е от съществено значение за бъдещето на технологията. По-долу са представени някои съвети, живот Hacks и интересни факти, които могат да насочат индивидуалните и организационни усилия, насочени към насърчаване на включителност и намаляване на пристрастията в ИИ системите.

Разбиране на пристрастията в ИИ

Една от първите стъпки към намаляване на пристрастията в ИИ е да се разбере какво представлява то. ИИ системите се учат от големи набори от данни и ако тези набори съдържат пристрастна информация, ИИ може да продължи да възпроизвежда тези пристрастия. Интересен факт е, че пристрастия могат да възникнат от небалансирани набори от данни — ако наборът от данни съдържа предимно изображения на високи бели мъже, ИИ, обучен на него, може да има затруднения да разпознава хора, които изглеждат различно.

Съвети за намаляване на пристрастията в ИИ

1. Разнообразни набори от данни: Уверете се, че обучаващите набори от данни за ИИ системите са представителни за населението. Това означава включване на широк спектър от възрасти, полове, етноси и типове тела в данните.

2. Редовни одити: Извършвайте редовни одити на ИИ системите, за да идентифицирате и адресирате пристрастия. Това включва тестване на ИИ в различни сценарии, за да се уверите, че работи еднакво добре за всички демографски групи.

3. Включителни дизайнерски екипи: Съберете разнообразни екипи за разработка на ИИ технологии. Различни перспективи могат да помогнат за ранна идентификация на потенциални пристрастия в процеса на разработка.

4. Обратни връзки: Внедрете стабилни механизми за обратна връзка, при които потребителите могат да докладват за неточности или пристрастия, позволяващи непрекъснато подобряване на ИИ системите.

Life Hacks за индивиди

– Включете се в ИИ: Когато използвате ИИ технологии, предоставяйте обратна връзка, когато е възможно, особено ако забележите пристрастия. Много компании разчитат на потребителски доклади, за да подобрят своите системи.

– Бъдете информирани: Следете дискусии и актуализации от експерти и организации, работещи по етика и справедливост в ИИ. Полезно е да знаете състоянието на пристрастията в ИИ и усилията за тяхното смекчаване.

Интересни факти за включителността на ИИ

– Отворени инициативи: Някои организации създадоха отворени набори от данни и инструменти, за да помогнат за откриването и коригирането на пристрастия в ИИ системите. Тези ресурси са безценни за разработчици, стремящи се да създадат по-справедливи ИИ технологии.

– Тенденции в законодателството: Правителствата по света започват да признават пристрастията в ИИ и създават регулации, насочени към насърчаване на справедливостта и отговорността при прилагането на ИИ.

Присъединете се към движението

Като се има предвид влиянието, което ИИ технологиите имат върху ежедневието, е важно хората да участват в разговорите относно политиката и етиката на ИИ. Независимо дали сте разработчик, политически деец или потребител, вашето мнение е ценливо. Всеки има роля в насочването на ИИ към по-включителни и безпристрастни резултати.

Като се възползвате от тези стратегии и предприемате проактивни стъпки, както индивидите, така и организациите могат да допринесат за създаването на ИИ системи, които по-добре обслужват всички членове на обществото. За повече информация относно ИИ и свързани теми, можете да посетите ресурси като IBM или MIT.