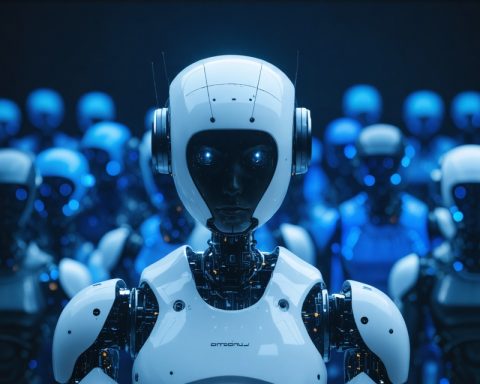

Artificial intelligence is evolving into “agentic AI,” acting autonomously in digital environments and reshaping business communications. Agentic AI can perform complex tasks without human intervention, such as booking travel arrangements, impacting how marketers engage with audiences. The traditional emotional core of marketing may be threatened, as focus shifts from appealing directly to consumers to influencing AI-driven decision-making processes. Marketing strategies