На нещодавньому форумі у Варні професор Маргарита Пешева наголосила на унікальних можливостях оповідання людей у порівнянні з штучним інтелектом (ШІ). Вона висловила помірний оптимізм щодо ШІ, підкреслюючи його зростаючий вплив у різних сферах. Однак вона попередила про потенційні проблеми, що виникають через те, що ШІ будує бази даних на основі власних виходів, що може призвести до дезінформації, подібно до “цифрового інцесту”.

Історично склалося так, що суспільні реакції на технологічні досягнення супроводжувались скептицизмом, про що свідчать рухи на кшталт луддитів. Пешева зазначила, що незважаючи на страхи, технологічний прогрес є неминучим і не становить загрози для майбутнього людства.

Вона вказала на розбіжності серед дослідників ШІ. Хоча деякі вважають, що люди в кінцевому підсумку контролюватимуть розвиток ШІ, інші — відомі постаті в технологіях — публічно закликали до паузи в розвитку ШІ, поки не будуть запроваджені регуляторні заходи. Це відображає постійні побоювання щодо управління швидкими технологічними змінами.

Пешева згадала нещодавнє законодавство Європейської Комісії щодо ШІ, підкресливши двохрічний процес перед його впровадженням. З огляду на швидкий розвиток ШІ, цей період може стати значною проблемою, оскільки технологія прогресує небаченими темпами.

Незважаючи на ці побоювання, Пешева залишається сповненою надії. Вона вважає, що вроджена креативність людства призведе до рішень і що крайній песимізм є необґрунтованим. Натомість вона виступає за довіру до людського генієм, яке є основою створення ШІ. Врешті-решт, вона відображає уявлення про збалансоване майбутнє, де людська інновація переважає над страхом.

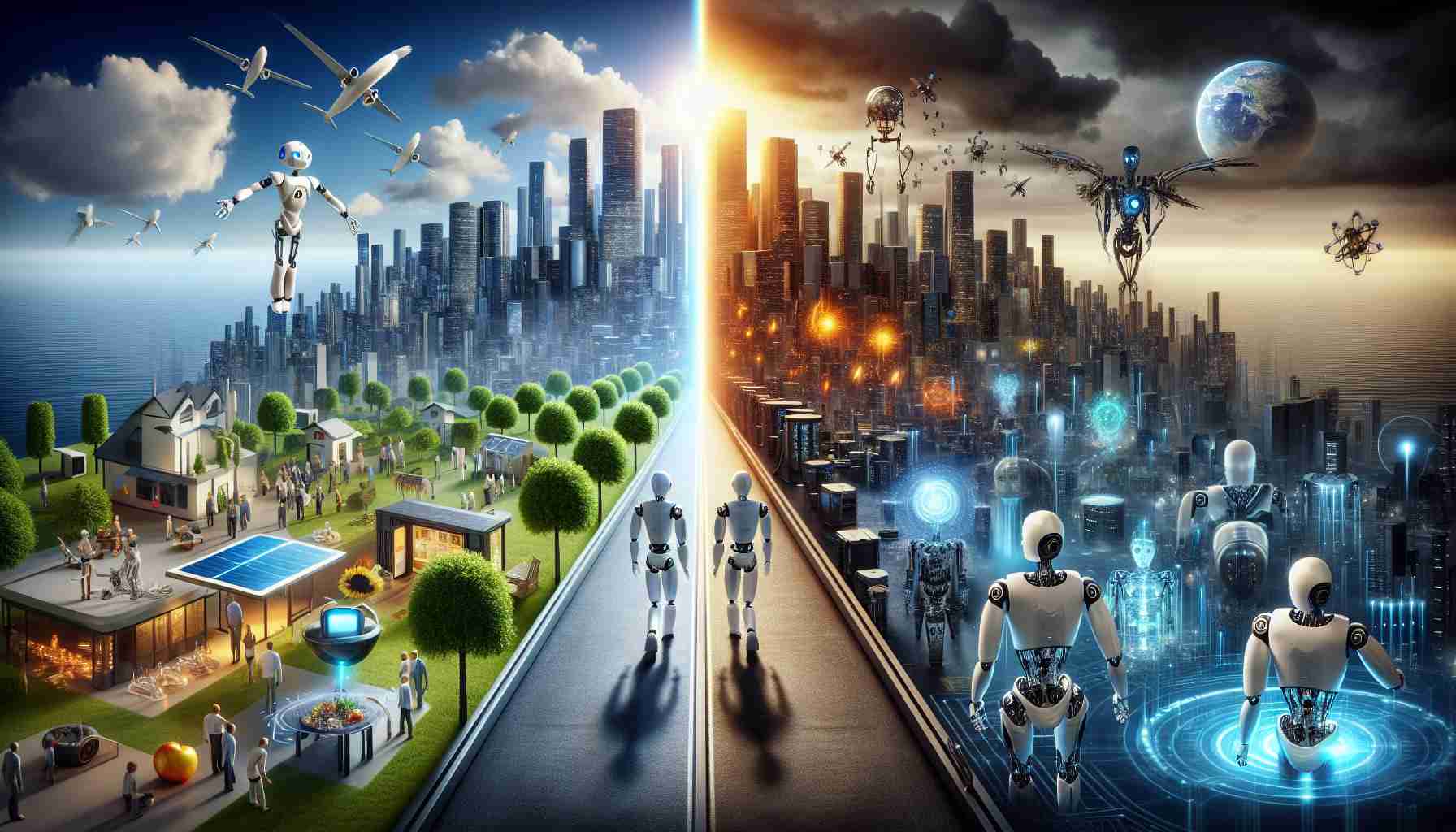

Майбутнє ШІ: збалансування оптимізму і обережності

Оскільки обговорення навколо штучного інтелекту (ШІ) продовжують розгортатися, майбутнє цієї технології виявляється сумішшю надії та побоювань. Виникаючий діалог не тільки відображає потенціал ШІ революціонізувати індустрії, але й підкреслює складні моральні, економічні та соціальні наслідки, які супроводжують його розвиток. Ця стаття поглиблюється в ключові питання, що стосуються майбутнього ШІ, його потенційних переваг та недоліків, а також критичних викликів, з якими ми стикаємося.

Які основні переваги технології ШІ?

Переваги ШІ є широкими і трансформаційними. Воно може підвищити продуктивність шляхом автоматизації рутинних завдань, покращити прийняття рішень через аналіз даних і впроваджувати нововведення у сферах, таких як охорона здоров’я, з прогнозною аналітикою та персоналізованою медициною. ШІ може оптимізувати ланцюги постачання, покращуючи ефективність у логістиці, і сприяти науковим дослідженням, швидше виявляючи патерни, ніж людські дослідники. Більше того, технології ШІ мають потенціал революціонізувати такі сфери, як управління навколишнім середовищем, шляхом розумного розподілу ресурсів і моніторінгових систем.

Які потенційні недоліки впровадження ШІ?

Незважаючи на безліч переваг, ШІ несе суттєві ризики. Одним з ключових проблем є втрата робочих місць, оскільки автоматизація може зробити багато професій застарілими, ведучи до економічної нерівності та соціальної нестабільності. Інша нагальна проблема — етичні наслідки, що стосуються приватності та безпеки даних, особливо коли системи ШІ збирають і аналізують величезні обсяги особистої інформації. Крім того, ризик упереджених алгоритмів може підтримувати існуючі соціальні нерівності, піднімаючи питання про справедливість і відповідальність у прийнятті рішень ШІ.

Які виклики та суперечки навколо розвитку ШІ?

Один з основних викликів у майбутньому ШІ — це регуляторне середовище. Уряди стикаються з темпами розвитку ШІ, які часто перевищують існуючі правові рамки. Це призвело до дебатів щодо потреби у глобальних стандартах для регулювання використання ШІ та запобігання його зловживанню. Більш того, обговорення щодо безпеки ШІ, особливо у зв’язку з автономними системами, ставить значні етичні дилеми. Чи повинні системи ШІ приймати життєво важливі рішення в охороні здоров’я або обороні? Відсутність прозорості в алгоритмах ШІ, що часто називається проблемою “чорної скриньки”, ще більше ускладнює відповідальність.

Які є найбільш нагальні питання, які нам потрібно вирішити?

1. Як ми можемо забезпечити, щоб ШІ розроблявся та використовувався етично?

Відповідь: Встановлення чітких етичних принципів і регуляторних рамок на національному та міжнародному рівнях є обов’язковим. Залучення зацікавлених сторін з різних секторів — уряду, промисловості, академії та громадянського суспільства — сприятиме комплексному підходу до етичного ШІ.

2. Як ми можемо зменшити ризики економічних порушень, спричинених ШІ?

Відповідь: Сприяння перенавчанню робочої сили та освіті буде критично важливим для підготовки працівників до змінюваного ринку праці. Політики повинні розглянути можливість введення універсального базового доходу та інших соціальних мереж безпеки для пом’якшення наслідків для втрачених робочих місць.

3. Чи існує ризик того, що ШІ перевершить контроль людей?

Відповідь: Хоча побоювання щодо надінтелектуального ШІ існують, експерти стверджують, що правильні регуляторні заходи та етичне програмування можуть зберегти контроль людей, гарантуючи, що ШІ працює як інструмент для доповнення, а не заміни можливостей людини.

4. Як ми можемо вирішити упередженість алгоритмів у системах ШІ?

Відповідь: Залучення різноманітних команд у розробку ШІ та регулярний аудит алгоритмів ШІ на предмет упередженості можуть допомогти зменшити публічні занепокоєння щодо справедливості та рівності результатів ШІ.

Висновок

Майбутнє ШІ є ландшафтом, багатим потенціалом, але переповненим викликами. Визнаючи як оптимізм, так і обережність, людство може відповідально вирішувати складності розвитку ШІ. Пошук збалансованого майбутнього передбачає співпрацю між технологами, політиками та громадськістю, щоб забезпечити, що ШІ служить на благо, сприяючи інноваціям, які покращують людські можливості, не компрометуючи етичні стандарти.

Для отримання додаткової інформації про досягнення та наслідки штучного інтелекту відвідайте MIT Technology Review і Oxford Academic.