I ett nyligen forum i Varna lyfte professor Margarita Pesheva fram människans unika berättarförmågor jämfört med artificiell intelligens (AI). Hon uttryckte en måttlig optimism inför AI och betonade dess växande inflytande inom olika områden. Hon varnade dock för potentiella problem som kan uppstå när AI bygger databaser baserat på sina egna resultat, vilket kan leda till desinformation, liknande ”digital incest.”

Historiskt sett har samhällets reaktioner på teknologiska framsteg inkluderat skepticism, vilket framgår av rörelser som Ludditerna. Pesheva noterade att trots rädslor är teknologisk utveckling oundviklig och inte ett hot mot mänsklighetens framtid.

Hon pekade på en klyfta bland AI-forskare. Vissa anser att människor i slutändan kommer att kontrollera AI-utvecklingen, medan andra – framstående personer inom teknologin – offentligt har efterlyst en paus i AI-framsteg tills reglerande åtgärder har införts. Detta speglar pågående oro över att hantera snabba teknologiska förändringar.

Pesheva nämnde den europeiska kommissionens senaste lagstiftning om AI och lyfte fram en tvåårig process innan dess genomförande. Givet den snabba utvecklingen av AI kan denna period utgöra betydande utmaningar, då teknologin fortskrider i en aldrig tidigare skådad takt.

Trots dessa bekymmer är Pesheva fortfarande hoppfull. Hon tror att mänsklighetens inneboende kreativitet kommer att leda till lösningar och att extrem pessimism är obefogad. Istället förespråkar hon för förtroende för mänsklig uppfinningsrikedom, som är grunden till AIs skapelse. Slutligen föreställer hon sig en balanserad framtid där mänsklig innovation har företräde framför rädsla.

Framtiden för AI: Balansera optimism och försiktighet

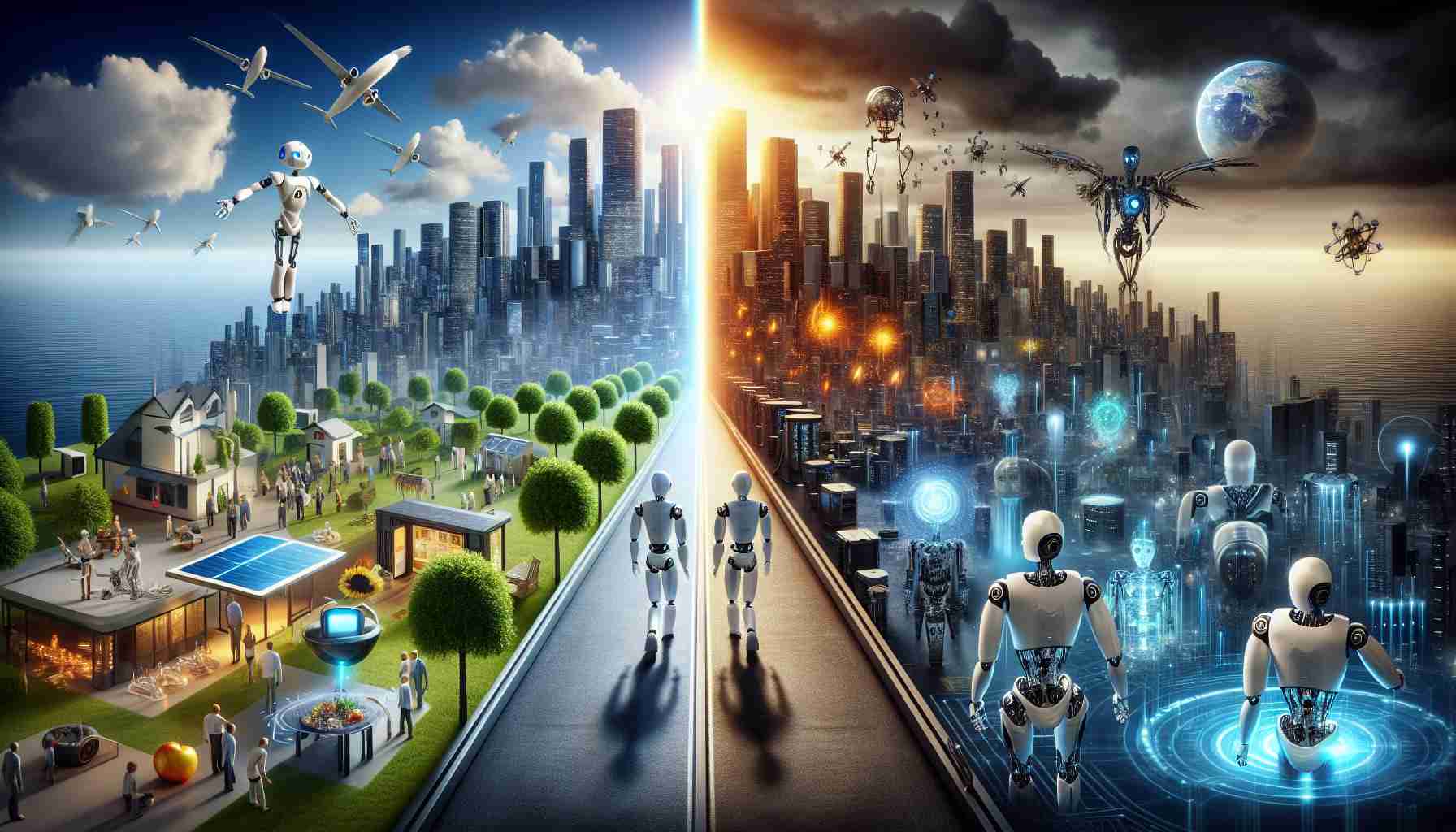

När diskussioner kring artificiell intelligens (AI) fortsätter att utvecklas framträder framtiden för denna teknologi som en blandning av hopp och trepidation. Den framväxande dialogen speglar inte bara potentialen hos AI att revolutionera industrier utan betonar även de komplexa moraliska, ekonomiska och sociala implikationer som följer med dess utveckling. Denna artikel undersöker de centrala frågorna kring framtiden för AI, dess potentiella fördelar och nackdelar samt de kritiska utmaningar vi står inför.

Vilka är de främsta fördelarna med AI-teknologi?

AI:s fördelar är omfattande och transformerande. Det kan öka produktiviteten genom att automatisera rutinuppgifter, förbättra beslutsfattande genom dataanalys och samarbeta inom områden som hälso- och sjukvård med prediktiv analys och personligt anpassad medicin. AI kan optimera försörjningskedjor, förbättra effektiviteten inom logistik och bidra till vetenskaplig forskning genom att identifiera mönster snabbare än mänskliga forskare. Dessutom har AI-teknologier potentialen att revolutionera områden som miljöförvaltning genom smart resursallokering och övervakningssystem.

Vilka är de potentiella nackdelarna med AI-implementering?

Trots sina många fördelar utgör AI betydande risker. En av de viktigaste oroarna är arbetslöshet, eftersom automatisering kan göra många yrken obsoleta, vilket leder till ekonomisk ojämlikhet och samhällelig instabilitet. En annan akut fråga är de etiska implikationerna kring integritet och dataskydd, särskilt när AI-system samlar in och analyserar stora mängder personlig information. Dessutom kan risken för partiska algoritmer upprätthålla redan existerande sociala ojämlikheter, vilket väcker frågor om rättvisa och ansvarighet i AI-beslutsfattande.

Vilka utmaningar och kontroverser omger AI-utvecklingen?

En av de främsta utmaningarna i AIs framtid är den reglerande landskapet. Regeringar kämpar med takten av AI-utveckling, som ofta överstiger befintliga rättsliga ramverk. Detta har lett till debatter om behovet av globala standarder för att styra AI-användning och förhindra missbruk. Dessutom ställer diskussionen om AI-säkerhet, särskilt i förhållande till autonoma system, betydande etiska dilemman. Ska AI-system fatta livs- och dödsbeslut inom hälso- och sjukvård eller försvar? Bristen på transparens i AI-algoritmer, ofta kallat ”svart låda”-problemet, komplicerar ytterligare ansvarighet.

Vilka är de mest akuta frågor vi behöver ta itu med?

1. Hur säkerställer vi att AI utvecklas och används etiskt?

Svar: Att etablera tydliga etiska riktlinjer och reglerande ramverk på både nationell och internationell nivå är avgörande. Att involvera intressenter från olika sektorer – regering, industri, akademi och det civila samhället – kommer att underlätta en omfattande ansats till etisk AI.

2. Hur kan vi minska riskerna för ekonomiska störningar orsakade av AI?

Svar: Att främja arbetskraftens omställning och utbildning kommer att vara avgörande för att förbereda arbetare för den föränderliga arbetsmarknaden. Beslutsfattare bör utforska universell basinkomst och andra sociala skyddsnät för att dämpa effekterna på arbetslösa arbetare.

3. Finns det en risk att AI övergår mänsklig kontroll?

Svar: Även om oro finns kring superintelligent AI, hävdar experter att korrekta reglerande åtgärder och etisk programmering kan upprätthålla mänsklig tillsyn, vilket säkerställer att AI fungerar som ett verktyg för att förstärka snarare än att ersätta mänskliga förmågor.

4. Hur kan vi ta itu med algoritmisk bias i AI-system?

Svar: Att införa mångsidiga team inom AI-utveckling och regelbundet granska AI-algoritmer för bias kan hjälpa till att mildra allmänhetens oro kring rättvisa och jämställdhet i AI-resultat.

Slutsats

Framtiden för AI är ett landskap rikt på potential men fullt av utmaningar. Genom att erkänna både optimism och försiktighet kan mänskligheten på ett ansvarsfullt sätt navigera i komplexiteten i AI-utvecklingen. Strävan efter en balanserad framtid innebär samarbete mellan teknologer, beslutsfattare och allmänheten för att säkerställa att AI tjänar det större goda och främjar innovationer som förbättrar mänskliga förmågor utan att kompromissa med etiska standarder.

För fler insikter om framstegen och konsekvenserna av artificiell intelligens, besök MIT Technology Review och Oxford Academic.