Enfoque Revolucionario

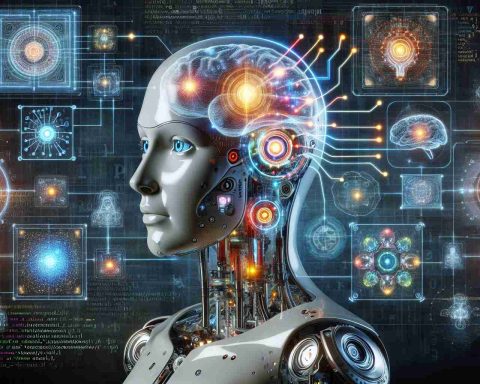

La iniciativa innovadora de Anthropic la diferencia de otros actores importantes en el campo de la inteligencia artificial. Mientras empresas como OpenAI y Google mantienen programas de recompensas por errores, el enfoque de Anthropic en problemas de seguridad específicos de la IA y la invitación a la revisión externa establecen un nuevo estándar de transparencia en la industria. Este enfoque distintivo muestra un compromiso para abordar los problemas de seguridad de la IA de manera directa.

Importancia Industrial

La iniciativa de Anthropic subraya el papel creciente de las empresas privadas en la definición de estándares de seguridad de la inteligencia artificial. Mientras los gobiernos luchan por estar al día con los avances rápidos, las empresas tecnológicas lideran el establecimiento de las mejores prácticas. Esto plantea preguntas cruciales sobre el equilibrio entre la innovación corporativa y la supervisión pública en la definición del futuro de la gobernanza de la IA.

Nuevo Modelo de Colaboración

El programa de la startup está inicialmente planeado como una iniciativa solo por invitación en colaboración con HackerOne, una plataforma que conecta a organizaciones con investigadores de ciberseguridad. Sin embargo, Anthropic tiene la intención de expandir el programa en el futuro, potencialmente creando un modelo de colaboración para la seguridad de la IA en toda la industria. El éxito o fracaso de esta nueva iniciativa podría establecer un precedente vital para cómo las empresas de IA abordan la seguridad en los próximos años.

Mejorando la Seguridad de la IA más Allá de la Superficie

La iniciativa pionera de Anthropic para la seguridad de la IA no solo resalta la importancia de la transparencia y la revisión externa, sino que también profundiza en las capas intrincadas de proteger los sistemas de inteligencia artificial. A medida que la industria tecnológica se adapta al paisaje en evolución de la IA, surgen varias preguntas clave y desafíos que acompañan este esfuerzo innovador.

Preguntas Clave:

1. ¿Cómo puede la colaboración entre empresas privadas e investigadores externos de ciberseguridad dar forma al futuro de los estándares de seguridad de la IA?

2. ¿Cuáles son las posibles implicaciones éticas de permitir que entidades privadas lideren el establecimiento de prácticas de seguridad de la IA?

3. ¿La invitación abierta para la revisión realmente fomentará la innovación o llevará inadvertidamente a la exposición de vulnerabilidades?

4. ¿Cómo pueden los gobiernos incorporar de manera efectiva las mejores prácticas establecidas por la industria en los marcos regulatorios para la gobernanza de la IA?

Desafíos y Controversias Clave:

– Preocupaciones de Privacidad: La revisión abierta de sistemas de IA puede plantear problemas de privacidad, especialmente si se expone información sensible durante las evaluaciones de seguridad.

– Protección de la Propiedad Intelectual: La colaboración con investigadores externos podría conducir a disputas sobre propiedad intelectual o fugas de información.

– Supervisión Ética: Equilibrar el impulso por la innovación con consideraciones éticas sigue siendo un desafío crítico para garantizar que la seguridad de la IA no comprometa los valores sociales.

Ventajas:

– Mayor Seguridad: Al invitar a la revisión externa, Anthropic puede identificar y abordar proactivamente posibles vulnerabilidades, mejorando la seguridad general de sus sistemas de IA.

– Liderazgo en la Industria: La iniciativa de Anthropic muestra un enfoque progresista hacia la seguridad de la IA, estableciendo un precedente para que otras empresas prioricen la transparencia y la colaboración.

– Catalizador de Innovación: El modelo colaborativo podría impulsar la innovación en las prácticas de seguridad de la IA al aprovechar la experiencia diversa de fuentes internas y externas.

Desventajas:

– Intensivo en Recursos: Gestionar un programa colaborativo de seguridad de la IA puede ser intensivo en recursos, requiriendo un tiempo y esfuerzo significativos para coordinarse con investigadores externos.

– Riesgo de Divulgación: Abrir los sistemas de IA a la revisión puede exponer inadvertidamente información patentada o vulnerabilidades del sistema que podrían ser explotadas.

– Ambigüedad Regulatoria: El paisaje en evolución de la gobernanza de la IA puede plantear desafíos para alinear las mejores prácticas establecidas por la industria con los marcos regulatorios, creando incertidumbre en el cumplimiento.

Para obtener más información sobre los avances en seguridad de la IA y las implicaciones para los estándares de la industria, visita el sitio web oficial de Anthropic.

[incrustar]https://www.youtube.com/embed/1HsedXWYD0U[/incrustar]