في منتدى حديث في فارنا، سلطت البروفيسورة مارغاريتا بيشيفا الضوء على قدرات سرد القصص الفريدة لدى البشر مقارنة بالذكاء الاصطناعي (AI). وأبدت شعوراً معتدلاً بالتفاؤل تجاه الذكاء الاصطناعي، مشددة على تأثيره المتزايد في مختلف المجالات. ومع ذلك، حذرت من القضايا المحتملة الناجمة عن بناء الذكاء الاصطناعي قواعد بيانات استنادًا إلى مخرجاته الخاصة، وهو ما يمكن أن يؤدي إلى معلومات مضللة، مشابهة لما يسمى “الاعتلال الرقمي”.

تاريخيًا، كان رد الفعل الاجتماعي على التقدم التكنولوجي يتضمن الشك، كما يتضح من حركات مثل اللوديتس. وأشارت بيشيفا إلى أنه على الرغم من المخاوف، فإن التقدم التكنولوجي حتمي وليس تهديدًا لمستقبل البشرية.

أشارت إلى وجود انقسام بين الباحثين في مجال الذكاء الاصطناعي. حيث يعتقد بعضهم أن البشر سيظلون يتحكمون في تطوير الذكاء الاصطناعي في النهاية، بينما دعا آخرون – شخصيات بارزة في التكنولوجيا – علنًا إلى التوقف عن تقدم الذكاء الاصطناعي حتى يتم وضع تدابير تنظيمية. وهذا يعكس المخاوف المستمرة بشأن إدارة التغيرات التكنولوجية السريعة.

استشهدت بيشيفا بالتشريعات الحديثة للجنة الأوروبية بشأن الذكاء الاصطناعي، مع التأكيد على أن هناك عملية تستغرق عامين قبل تنفيذها. ومع التطور السريع للذكاء الاصطناعي، قد تمثل هذه الفترة تحديات كبيرة، حيث تتقدم التكنولوجيا بوتيرة غير مسبوقة.

على الرغم من هذه المخاوف، تظل بيشيفا متفائلة. إذ تعتقد أن الإبداع الفطري لدى البشرية سيؤدي إلى حلول وأن التشاؤم الشديد ليس مبررًا. بدلاً من ذلك، تدعو إلى الثقة في براعة الإنسان، التي هي أساس إنشاء الذكاء الاصطناعي. وفي النهاية، تصور مستقبلاً متوازنًا حيث تتفوق الابتكارات البشرية على الخوف.

مستقبل الذكاء الاصطناعي: التوازن بين التفاؤل والحذر

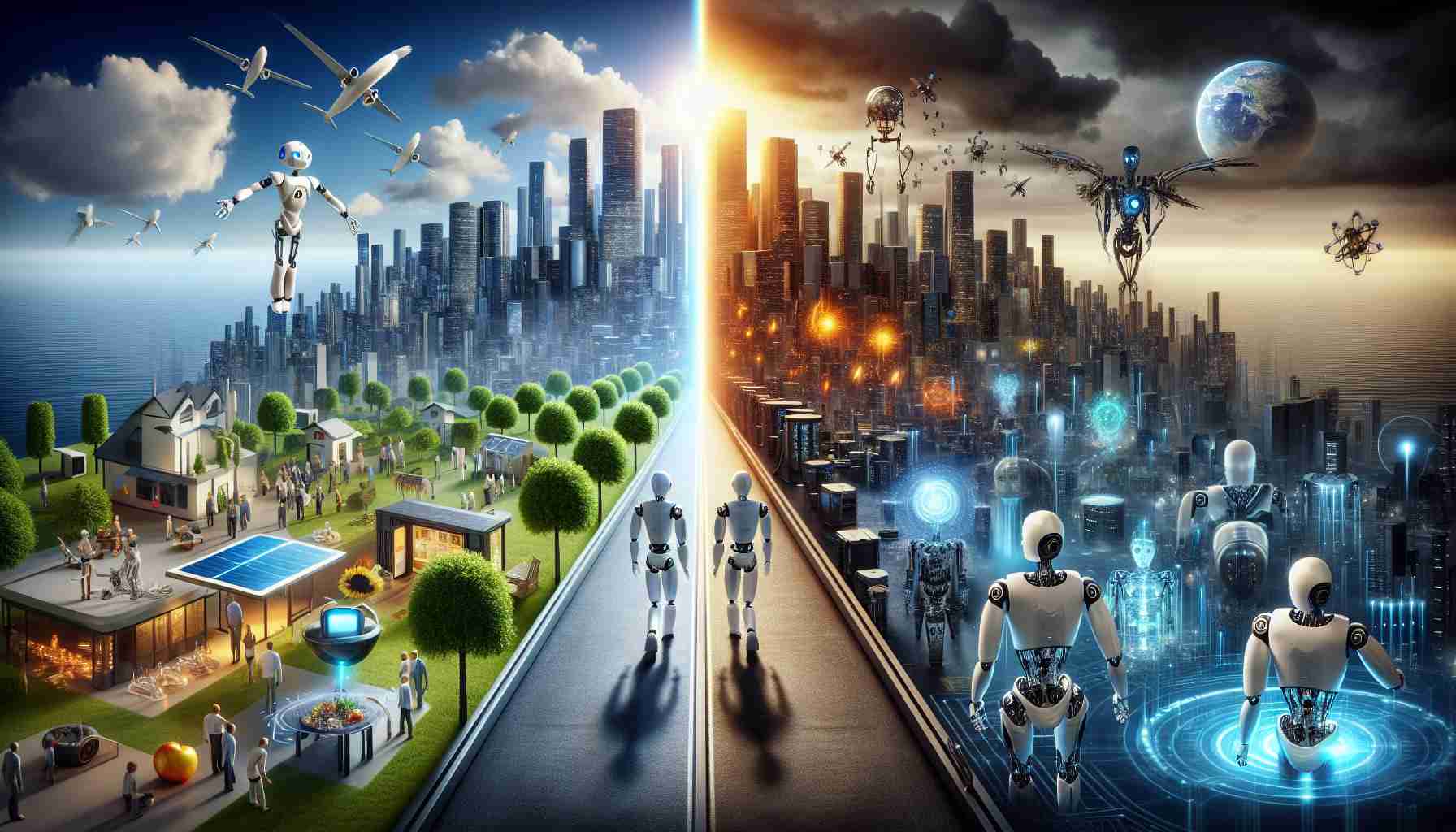

بينما تستمر المناقشات حول الذكاء الاصطناعي (AI) في التطور، يظهر مستقبل هذه التكنولوجيا كتركيبة من الأمل والقلق. تعكس الحوار الناشئ ليس فقط القدرة على تحويل الصناعات بواسطة الذكاء الاصطناعي، ولكن أيضًا تبرز التعقيدات الأخلاقية والاقتصادية والاجتماعية التي ترافق تقدمها. تتناول هذه المقالة الأسئلة الرئيسية المحيطة بمستقبل الذكاء الاصطناعي، والفوائد والمخاطر المحتملة، والتحديات الحاسمة التي نواجهها.

ما هي الفوائد الرئيسية لتكنولوجيا الذكاء الاصطناعي؟

تتمتع فوائد الذكاء الاصطناعي بشمولية وتحول عميق. يمكن أن تعزز الإنتاجية من خلال أتمتة المهام الروتينية، وتحسن عملية اتخاذ القرار من خلال تحليل البيانات، وتبتكر في مجالات مثل الرعاية الصحية باستخدام التحليلات التنبؤية والطب الشخصي. يمكن للذكاء الاصطناعي تحسين سلاسل الإمدادات، وزيادة كفاءة الخدمات اللوجستية، والمساهمة في البحث العلمي من خلال تحديد الأنماط بشكل أسرع من الباحثين البشر. علاوة على ذلك، تمتلك تقنيات الذكاء الاصطناعي القدرة على تغيير المجالات مثل إدارة البيئة من خلال تخصيص الموارد الذكية وأنظمة المراقبة.

ما هي المخاطر المحتملة لتنفيذ الذكاء الاصطناعي؟

على الرغم من فوائدها العديدة، فإن الذكاء الاصطناعي يشكل مخاطر كبيرة. واحدة من القضايا الحيوية هي فقدان الوظائف، حيث يمكن أن تؤدي الأتمتة إلى جعل العديد من المهن غير ضرورية، مما يؤدي إلى عدم المساواة الاقتصادية وعدم الاستقرار الاجتماعي. قضية ملحة أخرى هي الآثار الأخلاقية المتعلقة بالخصوصية وأمن البيانات، خاصة عندما تجمع أنظمة الذكاء الاصطناعي وتحلل كميات هائلة من المعلومات الشخصية. بالإضافة إلى ذلك، يمكن أن تستمر خوارزميات التحيز في perpetuating عدم المساواة الاجتماعية القائمة، مما يثير تساؤلات حول العدالة والمساءلة في اتخاذ قرارات الذكاء الاصطناعي.

ما هي التحديات والجدل المحيط بتطوير الذكاء الاصطناعي؟

تعد واحدة من التحديات الأساسية في مستقبل الذكاء الاصطناعي هي الإطار التنظيمي. تواجه الحكومات صعوبة في مجاراة سرعة تطوير الذكاء الاصطناعي، التي غالبًا ما تفوق الأطر القانونية الموجودة. وقد أدى هذا إلى مناقشات حول الحاجة إلى معايير عالمية لتنظيم استخدام الذكاء الاصطناعي ومنع إساءة استخدامه. علاوة على ذلك، تثير المناقشة بشأن سلامة الذكاء الاصطناعي، وبخاصة فيما يتعلق بالأنظمة الذاتية التشغيل، معضلات أخلاقية كبيرة. هل يجب أن تتخذ أنظمة الذكاء الاصطناعي قرارات الحياة والموت في الرعاية الصحية أو الدفاع؟ كما يزيد عدم الشفافية في خوارزميات الذكاء الاصطناعي، والتي تُعرف غالبًا بمشكلة “الصندوق الأسود”، من تعقيد المساءلة.

ما هي الأسئلة الأكثر أهمية التي نحتاج إلى معالجتها؟

1. كيف نضمن أن يتم تطوير واستخدام الذكاء الاصطناعي بشكل أخلاقي؟

الجواب: من الضروري وضع إرشادات أخلاقية واضحة وأطر تنظيمية على المستويين الوطني والدولي. سيساعد إشراك أصحاب المصلحة من مختلف القطاعات – الحكومة، الصناعة، الأوساط الأكاديمية، والمجتمع المدني – على تيسير نهج شامل نحو الذكاء الاصطناعي الأخلاقي.

2. كيف يمكننا تقليل مخاطر الاضطراب الاقتصادي الناتج عن الذكاء الاصطناعي؟

الجواب: سيكون تعزيز إعادة تدريب القوى العاملة والتعليم أمرًا حاسمًا في إعداد العمال للسوق المتغير. يجب على صانعي السياسات استكشاف دخل أساسي عالمي وغيرها من شبكات الأمان الاجتماعي لتخفيف تأثيرها على العمال الذين فقدوا وظائفهم.

3. هل هناك خطر من تجاوز الذكاء الاصطناعي السيطرة البشرية؟

الجواب: بينما توجد مخاوف بشأن الذكاء الاصطناعي الفائق، يجادل الخبراء بأن اتخاذ تدابير تنظيمية صحيحة وبرمجة أخلاقية يمكن أن يحافظ على الإشراف البشري، مما يضمن أن يعمل الذكاء الاصطناعي كأداة لتعزيز، بدلاً من استبدال، قدرات البشر.

4. كيف يمكننا معالجة التحيز الخوارزمي في أنظمة الذكاء الاصطناعي؟

الجواب: يمكن أن يساعد تنفيذ فرق متنوعة في تطوير الذكاء الاصطناعي وإجراء تدقيقات منتظمة على خوارزميات الذكاء الاصطناعي من أجل التحيز في تقليل المخاوف العامة بشأن العدالة والمساواة في نتائج الذكاء الاصطناعي.

الخاتمة

مستقبل الذكاء الاصطناعي هو مشهد غني بالإمكانيات ولكنه مفعم بالتحديات. من خلال الاعتراف بكل من التفاؤل والحذر، يمكن للبشرية التنقل في تعقيدات تطوير الذكاء الاصطناعي بشكل مسؤول. يتطلب السعي نحو مستقبل متوازن التعاون بين التقنيين وصانعي السياسات والجمهور لضمان أن يخدم الذكاء الاصطناعي المصلحة العامة، مما يعزز الابتكارات التي تعزز القدرات البشرية دون المساس بالمعايير الأخلاقية.

للحصول على مزيد من الرؤى حول التقدم وآثاره في مجال الذكاء الاصطناعي، قم بزيارة MIT Technology Review وOxford Academic.