En una era marcada por avances rápidos en inteligencia artificial, la integración de principios éticos en los sistemas de IA se ha convertido en un imperativo, aunque a menudo pasado por alto. A medida que la IA se entrelaza cada vez más con la vida cotidiana, desde vehículos autónomos hasta diagnósticos de salud, la necesidad de marcos éticos robustos es crítica.

El impulso por incorporar la ética en la IA proviene tanto de los beneficios potenciales como de los riesgos asociados con estas tecnologías. La IA tiene el poder de mejorar los procesos de toma de decisiones, aumentar la eficiencia e incluso resolver algunos de los problemas más apremiantes de la humanidad. Sin embargo, sin consideraciones éticas, los sistemas de IA corren el riesgo de perpetuar sesgos, erosionar la privacidad y exacerbar la desigualdad.

Uno de los desafíos clave en la ética de la IA es abordar el sesgo algorítmico. Los sistemas de IA se entrenan con vastos conjuntos de datos que pueden reflejar inadvertidamente los prejuicios sociales. Sin una supervisión cuidadosa, estos sesgos pueden amplificar la discriminación en campos como la contratación, el crédito y la aplicación de la ley. Abordar este problema requiere un entrenamiento de datos diverso y representativo y un monitoreo continuo de sesgos en los resultados de la IA.

Además, la transparencia y la responsabilidad son fundamentales para una IA ética. Las partes interesadas, incluidos desarrolladores, empresas y usuarios, deben entender cómo los sistemas de IA toman decisiones. Asegurar la transparencia puede ayudar a generar confianza y permitir a los usuarios identificar y corregir errores.

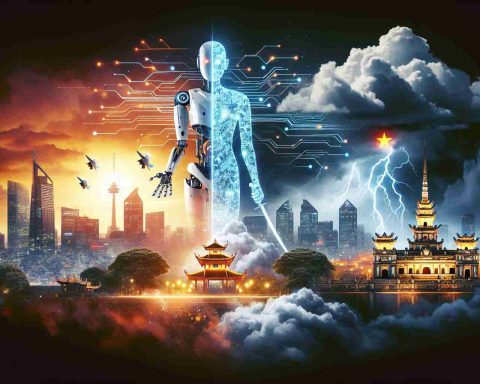

Los esfuerzos globales, como la Ley de IA de la Unión Europea y la Ley de Derechos de la IA de los Estados Unidos, destacan el compromiso continuo de integrar la ética en las tecnologías de IA. Estas iniciativas tienen como objetivo crear marcos que aseguren un desarrollo y despliegue responsables, reflejando los valores y prioridades de la sociedad.

En conclusión, la integración de la ética en la IA no es solo un obstáculo técnico, sino una necesidad social. A medida que la IA continúa evolucionando, mantener un compromiso firme con los principios éticos será crucial para dar forma a un futuro donde la tecnología sirva a toda la humanidad por igual.

Desvelando las Corrientes Subterráneas de la IA: Cómo la Ética Digital Definirá Nuestro Mundo

En nuestra continua exploración de la dimensión ética de la IA, surgen nuevas preguntas. ¿Pueden los principios morales alinearse realmente con la lógica artificial, y cuáles son las implicaciones sociales si no lo hacen? La IA ética no se trata solo de evitar daños; se trata de crear proactivamente sistemas que mejoren el bienestar humano. A medida que las tecnologías autónomas crecen en omnipresencia, esta búsqueda se convierte tanto en un desafío como en una oportunidad.

¿Por qué es importante la inteligencia emocional en la IA? Un ángulo sorprendentemente poco discutido es la incorporación de la inteligencia emocional en los sistemas de IA. La capacidad de la IA para interpretar y responder a las emociones humanas podría revolucionar áreas como el servicio al cliente y el apoyo en salud mental, ofreciendo interacciones sensibles y conscientes del contexto. Sin embargo, plantea preocupaciones sobre la manipulación, la privacidad y la autenticidad de tales respuestas «inteligentes».

Además, los países de todo el mundo también enfrentan implicaciones económicas debido a los desarrollos de IA ética. Las regiones que invierten en marcos de ética de IA pueden atraer empresas interesadas en mostrar responsabilidad, creando potencialmente nuevos sectores laborales enfocados en auditoría ética y cumplimiento. Por el contrario, la IA transparente puede imponer altos costos, afectando a los jugadores más pequeños en la industria tecnológica.

La privacidad de los datos sigue siendo otro tema controvertido. Las soluciones integrales de IA requieren acceso a datos personales, pero esto debe equilibrarse con la protección de los derechos individuales. No proteger la privacidad puede llevar a un uso indebido, una vigilancia aumentada y violaciones de datos, erosionando la confianza pública en estas tecnologías.

En última instancia, la integración ética en los sistemas de IA obliga a las comunidades y países a reevaluar y posiblemente redefinir sus contratos sociales. A medida que navegamos por estas complejidades, plataformas como Foro Económico Mundial y Naciones Unidas se vuelven cruciales para fomentar el diálogo y la cooperación hacia un progreso tecnológico equitativo. ¿Podría la ética de la IA algún día reflejar un código de conducta universal? El mundo observa y espera.