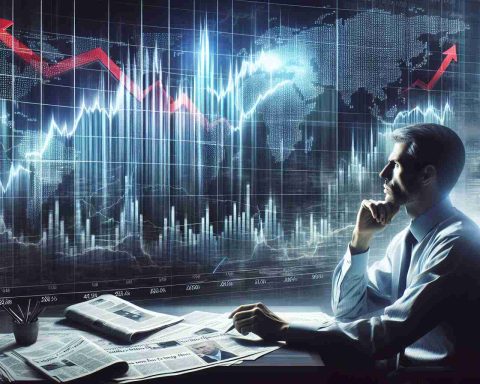

The Quantum Leap: Are We On the Verge of a Computing Revolution?

Quantum computing, poised to revolutionize technology, is advancing faster than anticipated, with significant momentum from startups like PsiQuantum. Karthee Madasamy, a key venture investor,