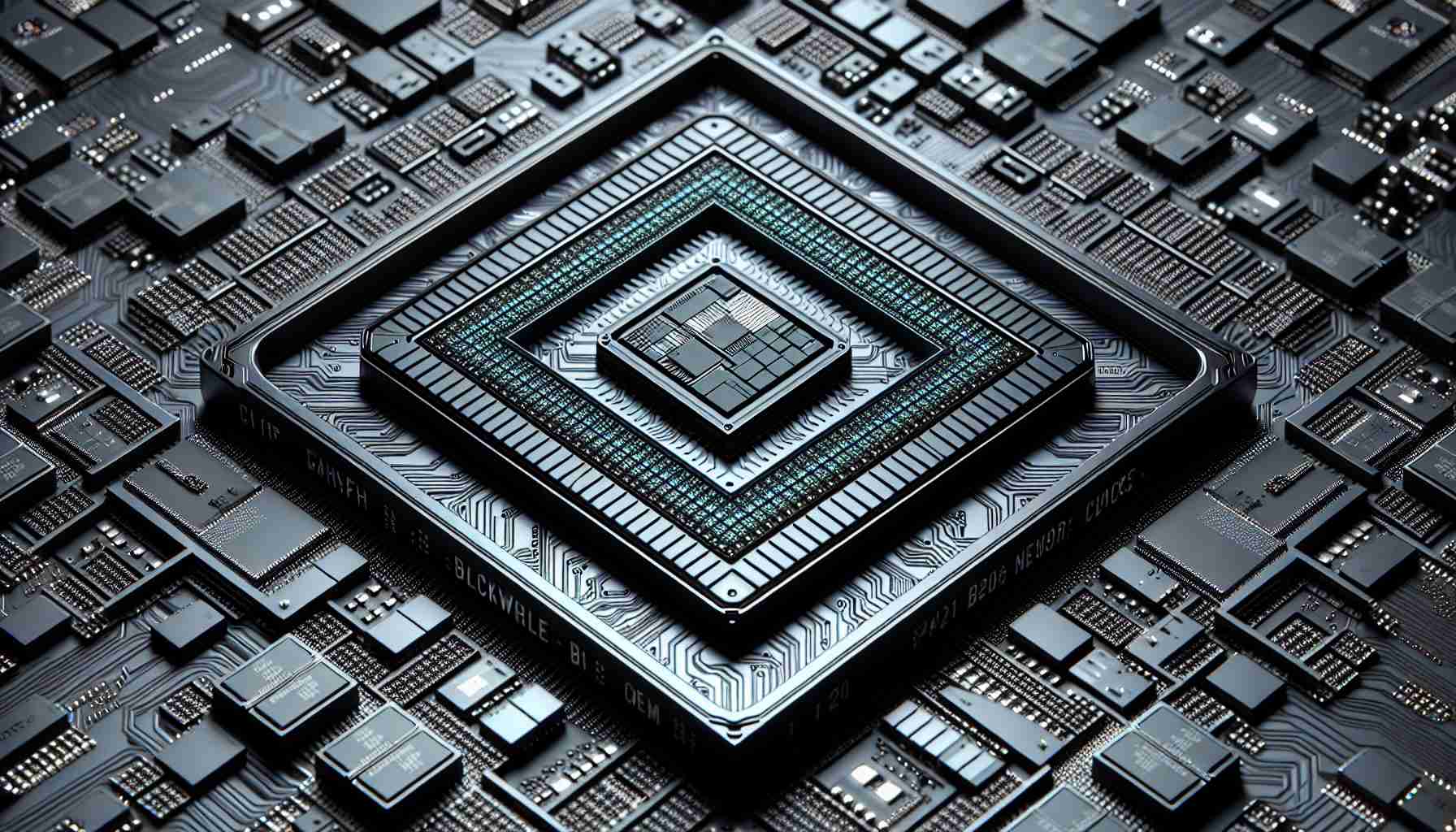

Nvidia heeft onlangs de lancering aangekondigd van zijn Blackwell B200 tensor core chip, die naar verluidt de krachtigste single-chip GPU is met een verbazingwekkende 208 miljard transistors. Volgens Nvidia kan de Blackwell B200-chip de operationele kosten en energieverbruik voor AI-inferentie tot 25 keer verminderen in vergelijking met zijn voorganger, de H100. Bovendien introduceerde Nvidia ook de GB200, een “superchip” die twee B200-chips combineert met een Grace CPU voor verbeterde prestaties.

De aankondiging vond plaats tijdens de jaarlijkse GTC-conferentie van Nvidia, waar CEO Jensen Huang een keynote speech gaf. Huang benadrukte de noodzaak van grotere GPU’s en verklaarde dat het Blackwell-platform de training van triljoen-parameter AI-modellen mogelijk zal maken die de complexiteit van huidige generatieve AI-modellen overtreffen. OpenAI’s GPT-3, uitgebracht in 2020, had 175 miljard parameters en diende als referentiepunt voor de complexiteit van AI-modellen.

De Blackwell-architectuur is vernoemd naar David Harold Blackwell, een gerenommeerde wiskundige en de eerste zwarte geleerde die werd opgenomen in de National Academy of Sciences. Dit platform introduceert zes technologieën voor versnelde computing, waaronder een tweede generatie Transformer Engine, vijfde generatie NVLink, RAS Engine, beveiligde AI-capaciteiten en een decompressiemotor voor versnelde databasevragen.

Verschillende grote organisaties zoals Amazon Web Services, Dell Technologies, Google, Meta, Microsoft, OpenAI, Oracle, Tesla en xAI hebben hun intentie uitgesproken om het Blackwell-platform te adopteren. De persverklaring van Nvidia bevat citaten van opmerkelijke tech-CEO’s, waaronder Mark Zuckerberg en Sam Altman, die het platform ondersteunen.

GPU’s, oorspronkelijk ontwikkeld voor gaming, blijken uiterst geschikt te zijn voor AI-taken vanwege hun sterk parallelle architectuur, waarmee matrixvermenigvuldigingstaken worden versneld die nodig zijn voor neurale netwerken. De focus van Nvidia op datacentertechnologieën heeft aanzienlijk bijgedragen aan zijn financiële succes, waarbij de omzet van datacenters ($18,4 miljard) de omzet van gaming GPU’s ($2,9 miljard) ruimschoots overstijgt.

De Grace Blackwell GB200-chip is een integraal onderdeel van de nieuwe NVIDIA GB200 NVL72, een vloeistofgekoeld datacentercomputersysteem dat specifiek is ontworpen voor AI-training en inferentietaken. Het bestaat uit 36 GB200’s, bestaande uit 72 B200 GPU’s en 36 Grace CPU’s die met elkaar verbonden zijn door de vijfde generatie NVLink voor verbeterde prestaties.

Volgens Nvidia biedt de GB200 NVL72 tot 30 keer meer prestaties in vergelijking met hetzelfde aantal NVIDIA H100 Tensor Core GPU’s voor LLM-inferentiewerklasten. Deze vooruitgang resulteert niet alleen in kosten- en energiebesparingen, maar maakt ook de ontwikkeling van complexere AI-modellen mogelijk. Computatiekrachtschaarste heeft vaak de voortgang op het gebied van AI belemmerd en de technologie van Nvidia tracht dit probleem aan te pakken.

Hoewel de beweringen van Nvidia over de mogelijkheden van het Blackwell-platform opmerkelijk zijn, zal de werkelijke prestatie en adoptie van de technologie afhangen van de implementatie en het gebruik door organisaties. Concurrenten zoals Intel en AMD dingen ook mee naar een aandeel in de AI-markt, wat bijdraagt aan de concurrentie en innovatie.

Nvidia verwacht dat op Blackwell-gebaseerde producten later dit jaar beschikbaar zullen zijn.

De Blackwell B200 tensor core chip is de krachtigste single-chip GPU van Nvidia, met indrukwekkende 208 miljard transistors. Het is ontworpen om de operationele kosten en energieverbruik voor AI-inferentie aanzienlijk te verminderen.

De GB200 “superchip” combineert twee B200-chips en een Grace CPU om de prestaties verder te verbeteren. Het is bedoeld voor geavanceerde AI-toepassingen en taken.

Belangrijke organisaties zoals Amazon Web Services, Dell Technologies, Google, Meta, Microsoft, OpenAI, Oracle, Tesla en xAI worden verwacht het Blackwell-platform te adopteren voor hun op AI gebaseerde operaties.

GPU’s zijn goed geschikt voor AI-taken vanwege hun sterk parallelle architectuur, waarmee matrixvermenigvuldigingstaken die nodig zijn voor het efficiënt uitvoeren van neurale netwerken worden versneld.

De Grace Blackwell GB200-chip is een belangrijk onderdeel van het NVIDIA GB200 NVL72 datacentercomputersysteem. Het maakt verbeterde AI-training en inferentietaken mogelijk en biedt aanzienlijke prestatieverbeteringen in vergelijking met eerdere GPU-modellen.

Ja, de verhoogde prestaties en verbeterde mogelijkheden van het Blackwell-platform kunnen de ontwikkeling van complexere AI-modellen mogelijk maken. Dit is met name gunstig voor computationeel veeleisende generatieve AI-modellen die aanzienlijke rekenkracht vereisen.

Hoewel Nvidia aanzienlijke beweringen heeft gedaan over het Blackwell-platform, moet de werkelijke prestatie en adoptie door organisaties nog worden gezien. Concurrenten zoals Intel en AMD zijn ook actief bezig met het nastreven van vooruitgang in AI-technologie, wat leidt tot concurrentie op de markt.

De lancering van Nvidia’s Blackwell B200 tensor core chip heeft aanzienlijke interesse in de industrie gegenereerd. De chip wordt geprezen als de krachtigste single-chip GPU, met indrukwekkende 208 miljard transistors. Nvidia beweert dat de Blackwell B200 de operationele kosten en energieverbruik voor AI-inferentie tot 25 keer kan verminderen in vergelijking met zijn voorganger, de H100. Deze vooruitgang heeft het potentieel om de AI-computing te revolutioneren en het toegankelijker te maken voor een breed scala van toepassingen.

Een van de belangrijke hoogtepunten van de aankondiging van Nvidia is de introductie van de GB200 “superchip.” Deze superchip combineert twee B200-chips met een Grace CPU om nog hogere prestaties te leveren. Het is specifiek ontworpen voor geavanceerde AI-toepassingen en taken die aanzienlijke rekenkracht vereisen. De combinatie van de B200-chips en Grace CPU opent nieuwe mogelijkheden voor AI-ontwikkeling en onderzoek.

Wat betreft marktadoptie, hebben verschillende grote organisaties hun intentie uitgesproken om het Blackwell-platform te omarmen. Branchegiganten zoals Amazon Web Services, Dell Technologies, Google, Meta, Microsoft, OpenAI, Oracle, Tesla en xAI hebben allemaal interesse getoond in het benutten van deze krachtige technologie voor hun op AI gebaseerde operaties. De goedkeuringen van tech-CEO’s zoals Mark Zuckerberg en Sam Altman bevestigen verder het potentieel van het platform.

Het succes van de GPU’s van Nvidia op de AI-markt is te danken aan hun sterk parallelle architectuur, waarmee matrixvermenigvuldigingstaken vereist voor neurale netwerken worden versneld. Deze architectuur was oorspronkelijk ontwikkeld voor gamingdoeleinden, maar heeft aanzienlijk succes geboekt in de AI-computing. In feite heeft de omzet van Nvidia uit datacenters ($18,4 miljard) de omzet van gaming GPU’s ($2,9 miljard) aanzienlijk overtroffen.

The source of the article is from the blog hashtagsroom.com